Comment installer et utiliser Ollama pour exécuter de grands modèles de langage (LLM) sur votre ordinateur Windows 11

Il existe plusieurs façons d'exécuter des modèles de langage volumineux (LLM) localement sur votre machine Windows, et Ollama est l'une des plus simples et des plus efficaces.

L'interaction la plus courante que la plupart d'entre nous avons avec l'IA à l'heure actuelle se fait via des outils basés sur le cloud comme ChatGPT ou CopiloteCes outils nécessitent une connexion Internet pour être utilisés, mais l’inconvénient est qu’ils peuvent être utilisés sur presque tous les appareils.

Mais tout le monde, et surtout les développeurs, ne souhaite pas s'appuyer sur le cloud pour ses applications d'IA. Il est donc essentiel que votre modèle de langage étendu (LLM) s'exécute localement sur votre machine. C'est là qu'Ollama entre en jeu.

Ollama est un outil d'inférence qui vous permet d'exécuter nativement un large éventail de grands modèles de langage (LLM) sur votre ordinateur. Ce n'est pas la seule façon de procéder, mais c'est l'une des plus simples et des plus directes. Ollama vous permet d'exploiter la puissance de l'IA sans connexion internet permanente, vous offrant ainsi un contrôle total sur vos données et votre confidentialité.

Une fois opérationnel, vous disposez de nombreuses possibilités avec Ollama et les grands modèles de langage (LLM) qu'il utilise, mais la première étape est la configuration. Nous vous guiderons pas à pas dans cette démarche pour tirer le meilleur parti de cet outil performant.

Configuration requise pour Ollama

L'exécution d'Ollama ne consomme pas beaucoup de ressources système et peut être exécutée sur une large gamme d'appareils. Il est compatible avec Windows 11, macOS et Linux. Vous pouvez même l'utiliser depuis vos distributions Linux sous Windows 11 via WSL.

Cependant, l'exécution de grands modèles linguistiques (LLM) nécessite un matériel plus puissant. Plus le modèle est grand, plus la puissance de traitement requise est importante. Ces modèles nécessitent un processeur graphique (GPU). Actuellement, ils ne sont pas optimisés pour l'unité de traitement neuronal (NPU) des nouveaux PC Copilot+.

Heureusement, il existe des modèles plus petits utilisables sur du matériel modeste. Par exemple, le modèle Gemma 3 de Google, doté d'un modèle à 1 milliard de paramètres, ne nécessite que 2.3 Go de mémoire vive (VRAM) pour exécuter le modèle complet. Ce nombre passe à plus de 9 Go de VRAM si l'on passe au modèle à 4 milliards de paramètres.

Il en va de même pour Llama 3.2 de Meta : le modèle à 1 milliard de paramètres nécessite un GPU avec seulement 4 Go de VRAM pour fonctionner correctement. Ce nombre passe ensuite à 8 Go pour le modèle à 3 milliards de paramètres.

En bref, si vous disposez d'un ordinateur relativement moderne avec au moins 8 Go de RAM et un GPU dédié, vous devriez pouvoir bénéficier de certains avantages en utilisant Ollama.

Guide d'installation d'Ollama sur Windows 11

L'installation d'Ollama sur Windows 11 est un processus très simple, qui se résume au téléchargement Installez le programme depuis le site officiel Ou de Référentiel GitHub, puis installez-le sur votre appareil.

Voici les étapes simples.

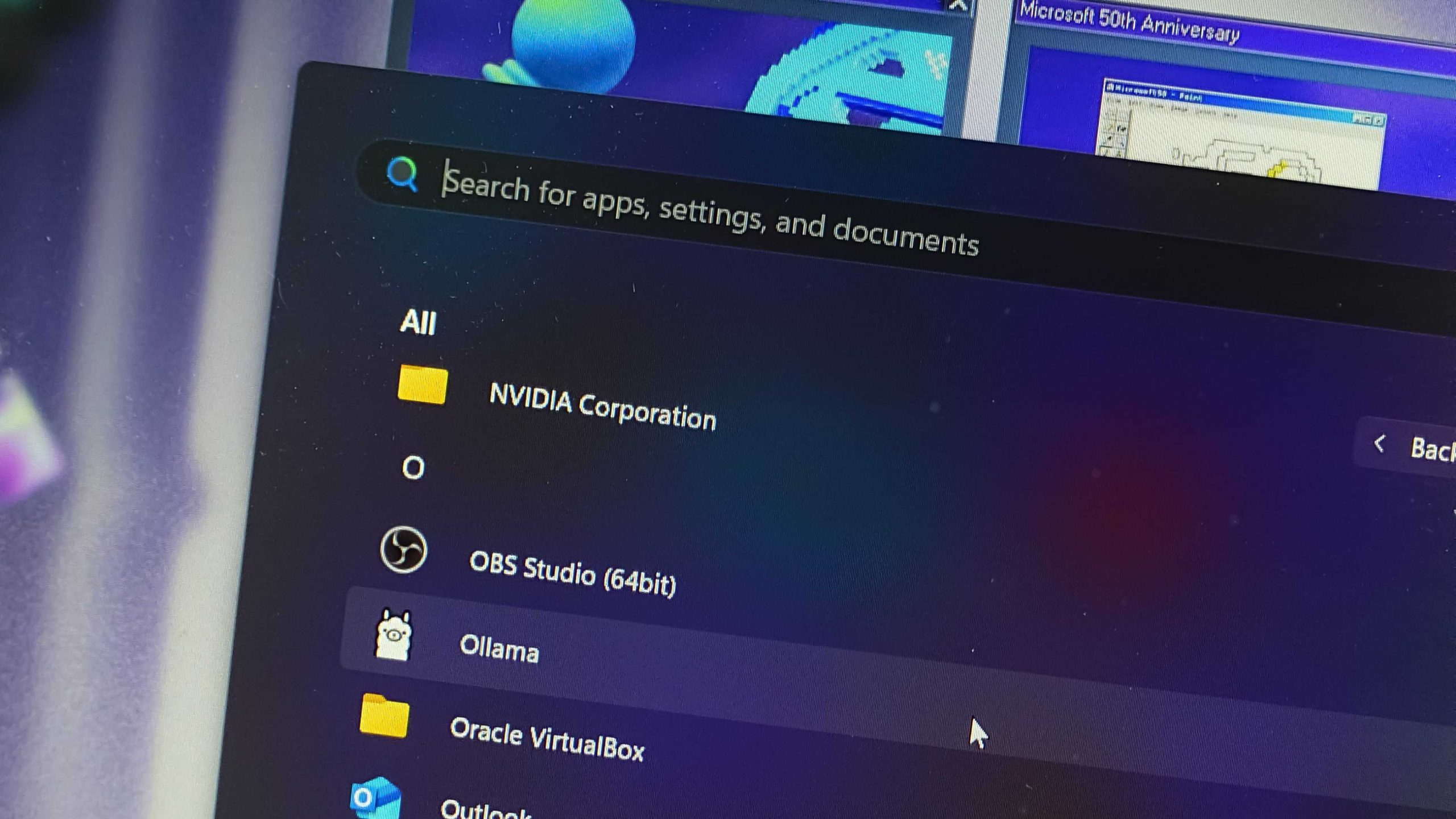

Après l'installation et le lancement, rien n'apparaîtra sur votre bureau. Le programme s'exécute entièrement en arrière-plan, mais vous pouvez voir son icône dans la barre des tâches.

Pour vérifier que le programme fonctionne correctement, vous pouvez vous rendre à l'adresse localhost: 11434 Dans votre navigateur Web.

Installez et exécutez votre premier grand modèle de langage (LLM) sur Ollama

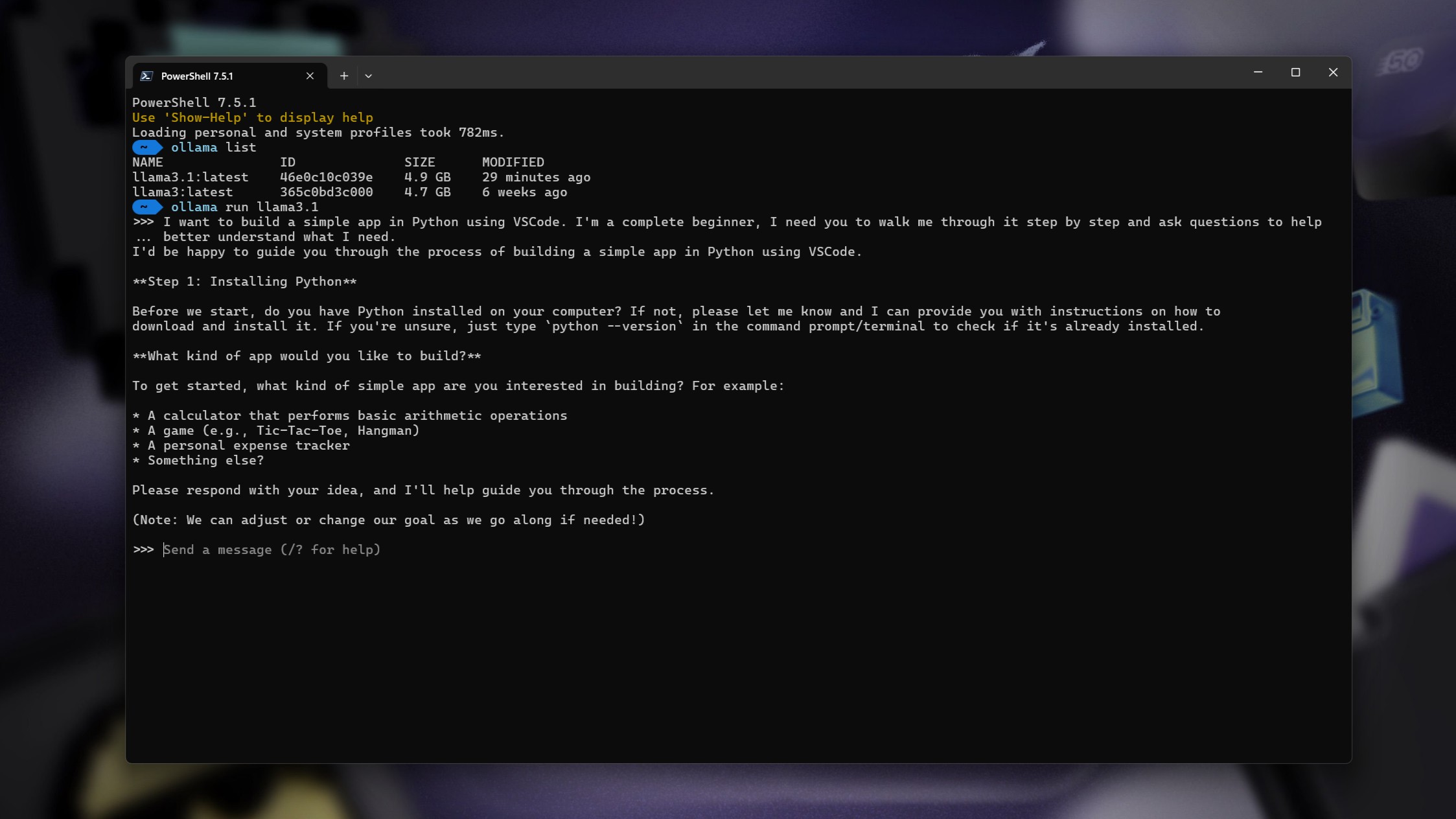

Pour exécuter votre premier grand modèle de langage (LLM) avec Ollama, vous devrez principalement utiliser l'interface de ligne de commande (CLI). Ouvrez PowerShell sous Windows ou utilisez WSL si Ollama y est installé.

Bien qu'il existe des interfaces utilisateur graphiques (GUI) pour Ollama, nous nous concentrons ici sur l'utilisation de la ligne de commande. Il est conseillé de maîtriser l'interface de ligne de commande.

Les deux principales choses que vous devez savoir sont :

courir

mets-le

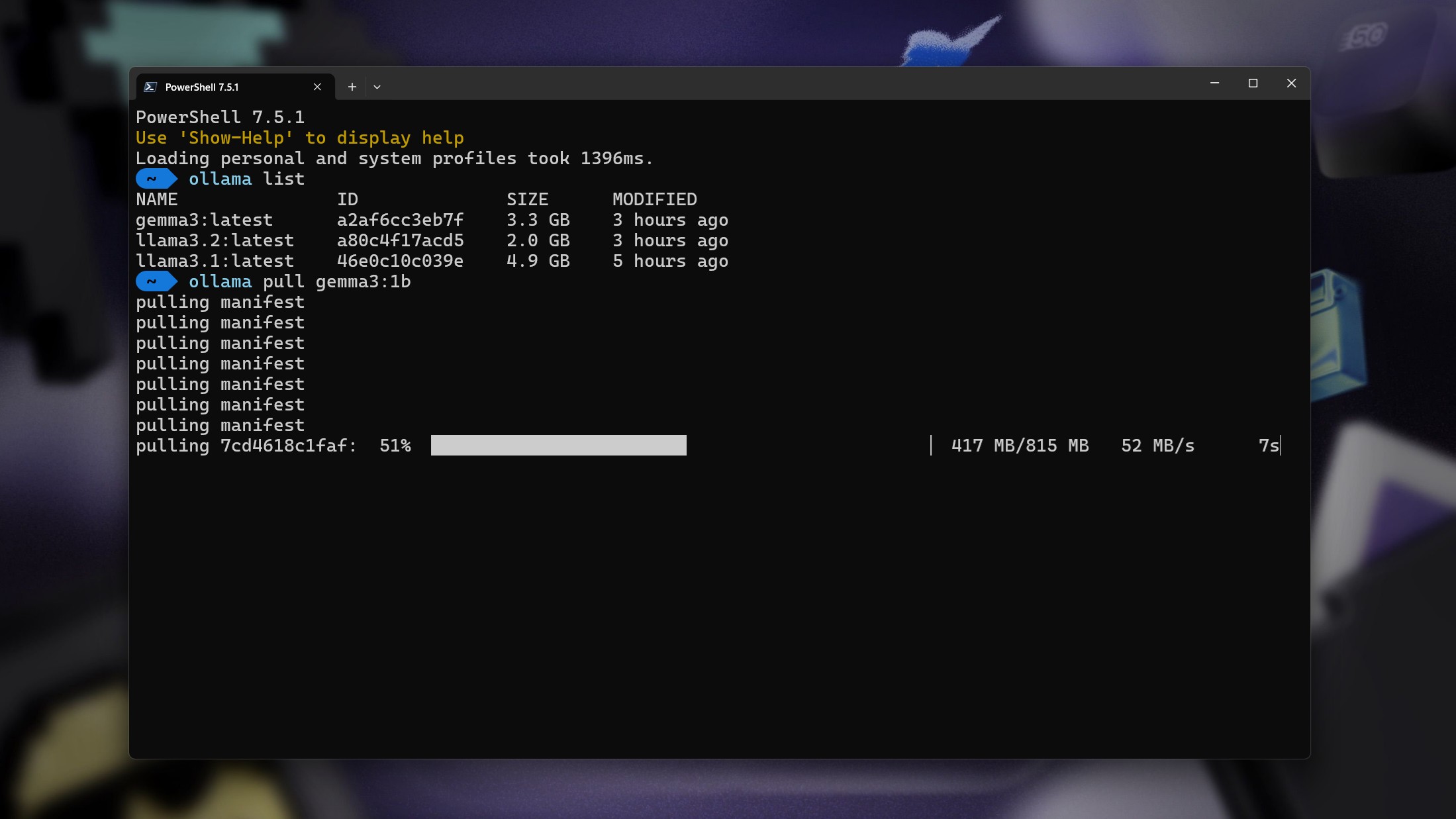

Si vous demandez à Ollama d'exécuter un modèle LLM non installé, il le téléchargera automatiquement, puis l'exécutera. Vous trouverez facilement les noms corrects des modèles de langage volumineux que vous souhaitez installer sur Site Web d'Ollama.

Par exemple, pour installer et exécuter le modèle Google Gemma 3 LLM à 1 milliard de paramètres, entrez la commande suivante :

course d'ollama Gemma:1b

Notez que l'ajout :1b Après le nom, indiquez que vous souhaitez un modèle avec 1 milliard de paramètres. Si vous souhaitez un modèle avec 4 milliards de paramètres, remplacez-le par **:4b**.

L'exécution de formulaires sur votre terminal ouvrira une expérience de chatbot familière, vous permettant d'écrire vos invites et de recevoir des réponses, le tout exécuté localement sur votre appareil.

Pour quitter le formulaire et revenir à PowerShell, tapez simplement **/bye** et le processus sera terminé.

Ce cours couvre les bases de la configuration d'Ollama sur votre ordinateur pour utiliser la suite de LLMs disponibles. L'expérience de base est très simple et facile à utiliser, ne nécessitant pratiquement aucune connaissance technique. Si j'y suis parvenu, vous le pouvez aussi !

Les commentaires sont fermés.