Comment installer localement les derniers Large Language Models (LLM) sur un Mac

Ces dernières années, les grands modèles de langage (LLM) ont gagné en popularité grâce à leur capacité à générer du texte proche de la langue humaine et à faciliter diverses tâches. Si tous les modèles ne sont pas libres de droits, la plupart des grandes entreprises technologiques proposent une version téléchargeable et exécutable par les utilisateurs.

L'exécution de ces modèles localement sur votre Mac peut s'avérer avantageuse pour des raisons de confidentialité et de coût. Dans cet article, nous verrons comment installer et exécuter des LLM. OllamaC'est un outil puissant pour les développeurs et les utilisateurs novices, et nous aborderons quelques outils d'interface utilisateur graphique qui peuvent simplifier le processus pour ceux qui préfèrent ne pas utiliser le Terminal macOS.

De cette manière, vous pouvez accéder aux derniers modèles de texte alimentés par l'IA de [Google], [Microsoft], [Meta] et d'autres sociétés d'IA telles que [Mistral] et [DeepSeek].

Comprendre les LLM : que signifient les paramètres ?

Avant de nous plonger dans le processus d'installation, clarifions ce que signifient des chiffres comme «7B"Ou"14BLorsqu'il s'agit de LLM, ces chiffres représentent la taille du modèle en termes de Paramètres (En milliards), qui sont essentiellement des « poignées et des interrupteurs » qui sont ajustés avec précision pendant la formation.

Un plus grand nombre de paramètres permet au modèle de saisir des schémas et des relations plus complexes dans la langue, ce qui peut potentiellement améliorer ses performances. Toutefois, il est important de noter qu'un plus grand nombre de paramètres ne garantit pas toujours de meilleurs résultats ; la qualité des données d'entraînement et les ressources de calcul disponibles pour le modèle jouent également un rôle important.

Configuration système requise

Vous devrez vous assurer que votre [Mac] possède au moins les spécifications suivantes :

- macOS 10.15 ou version ultérieure (macOS 13 ou version ultérieure recommandé)

- Au moins 8 Go de RAM (16 Go ou plus recommandés)

- 10 Go d'espace de stockage libre (le minimum requis pour les modèles les plus petits ; les modèles plus avancés avec un nombre maximal de paramètres nécessitent environ 700 Go)

- Processeur multicœur [Intel] ou processeur [Apple Silicon] (M2 ou supérieur de préférence)

Installer Ollama

Ollama C'est un outil open source qui vous permet d'exécuter des LLM directement sur votre machine locale. Voici comment procéder :

- Télécharger Ollama: Visitez le site Internet Ollama Téléchargez la version macOS. Vous pouvez également l'installer via Homebrew en exécutant la commande suivante :

brew install ollamaDans votre terminal.

- Installer OllamaSi vous avez téléchargé le programme d'installation, double-cliquez dessus et suivez l'assistant d'installation. Si vous utilisez Homebrew, passez à l'étape 4.

- L'étape suivante pour l'installateur consiste simplement à cliquer sur le bouton. InstallerOn vous demandera alors votre mot de passe administrateur.

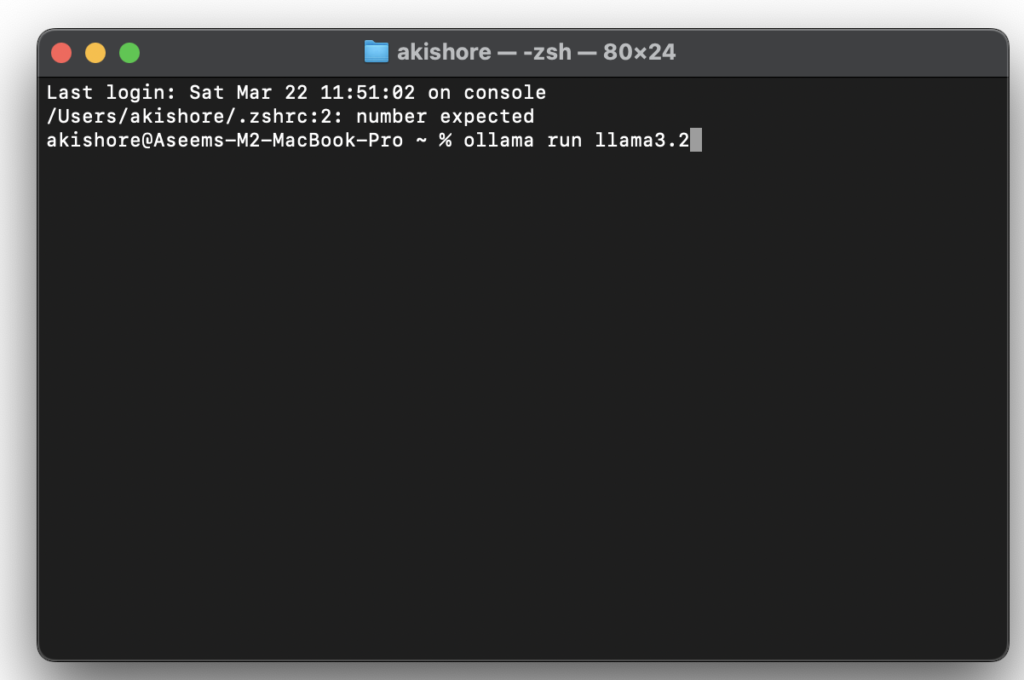

- Exécutez OllamaOuvrez une fenêtre de terminal et démarrez Ollama en tant que service à l'aide de la commande

brew services start ollamaCela permettra à Ollama d'être disponible à cette adressehttp://localhost:11434/. - Téléchargez et exécutez le modèleUtilisez la commande

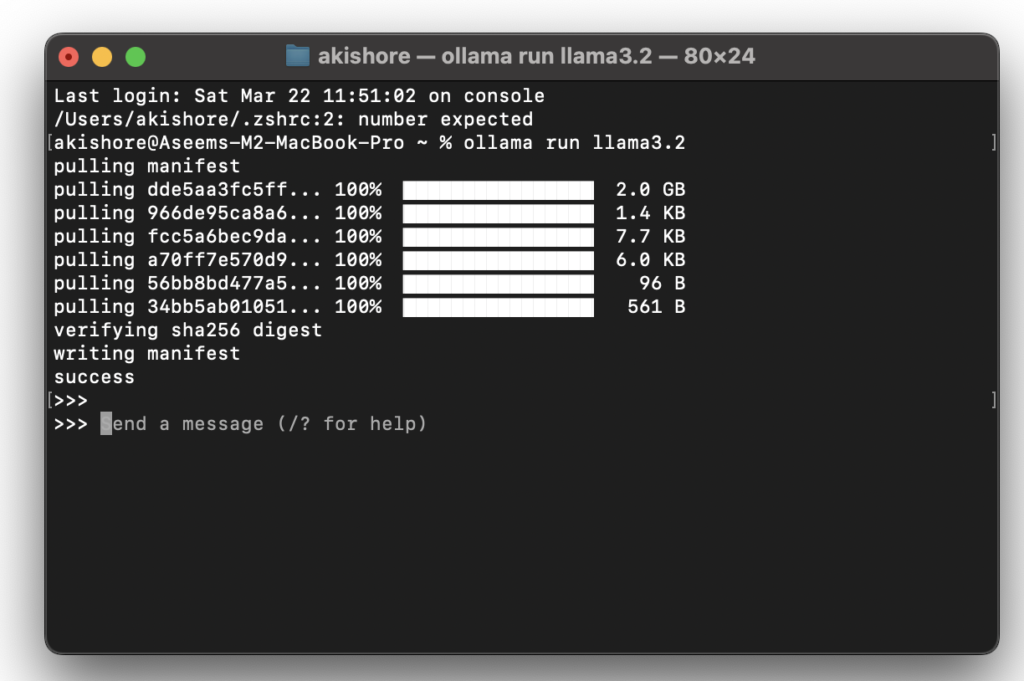

ollama pull <model-name>Pour télécharger un modèle, utilisez la commandeollama run <model-name>Pour l'exécuter. Par exemple, pour exécuter un modèle DeepSeek-R1Utilisez la commandeollama pull deepseek-r1Suivi de la commandeollama run deepseek-r1. - Pour télécharger une version plus grande du modèle, ajoutez simplement deux points verticaux suivis de la taille. Par exemple, pour télécharger un modèle 14B DeepSeekVous utiliserez la commande ollama run deepseek-r1:14bSur le site web d'Ollama, vous pouvez cliquer sur n'importe quel formulaire et toutes les commandes différentes pour chaque version vous seront affichées.

Vous pouvez trouver la liste complète de Modèles Ollama Vous pouvez également utiliser la deuxième commande comme décrit ci-dessus ; si elle n’est pas déjà installée, elle téléchargera d’abord le formulaire puis l’exécutera.

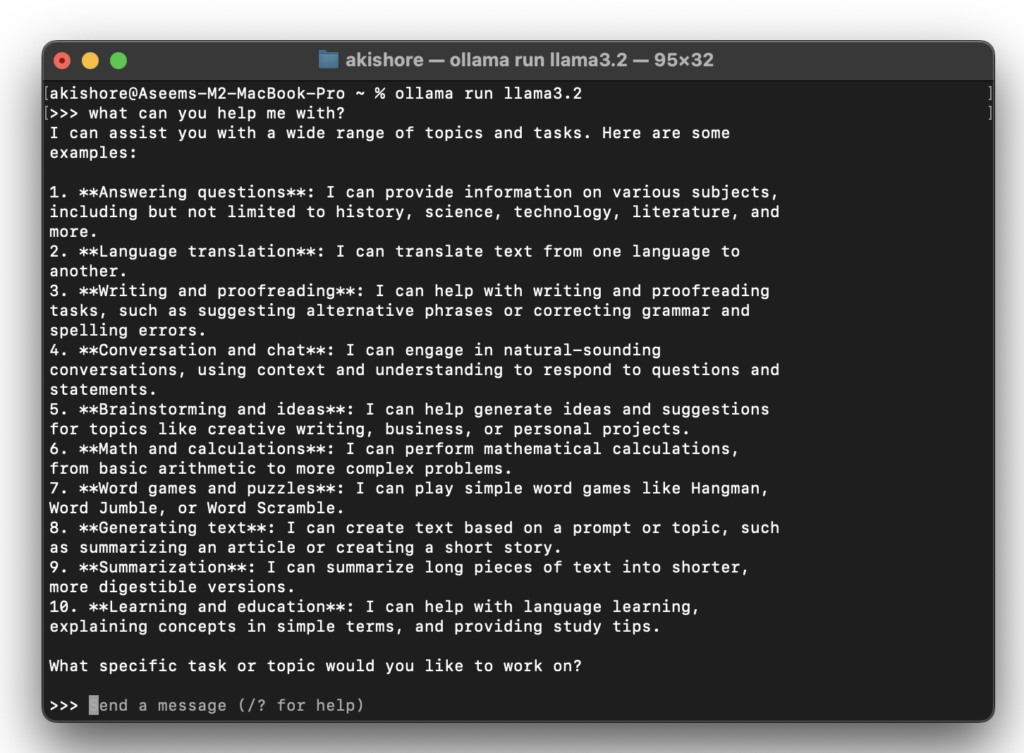

Maintenant que vous voyez les trois flèches à angle droit (>>>), vous pouvez commencer à saisir des commandes dans le formulaire.

Voilà ! Vous pouvez désormais interagir localement avec votre assistant virtuel en IA sans vous soucier des coûts, de la surutilisation ou de la confidentialité de vos écrits. C'est idéal si vous souhaitez aborder des sujets sensibles ou personnels avec votre assistant virtuel, sans qu'une grande entreprise technologique puisse lire vos pensées.

Utilisation d'outils d'interface utilisateur graphique avec Ollama

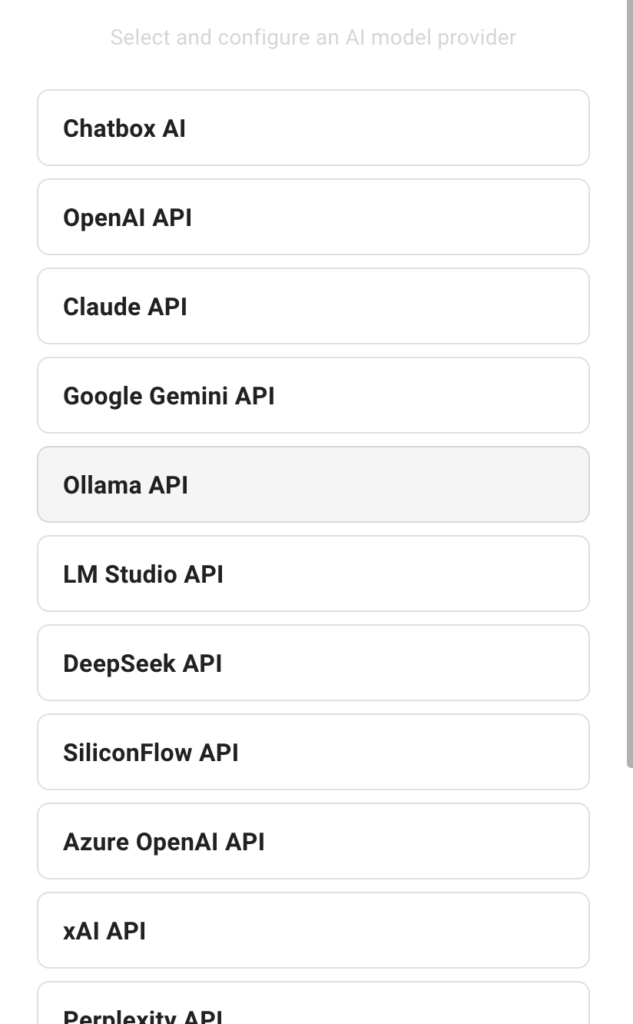

Bien qu'Ollama soit un outil puissant et performant pour les développeurs, certains utilisateurs peuvent préférer une interface graphique (GUI) pour interagir avec les LLM. Voici quelques outils permettant de créer une interface graphique pour Ollama :

-

-

- Interface graphique OllamaIl s'agit d'une application gratuite et open source pour macOS, développée avec SwiftUI. Elle offre une interface élégante et constitue une excellente option pour ceux qui souhaitent accéder aux formulaires LLM localement, sans utiliser de terminal.

- Ollama UIUne interface utilisateur web simple, basée sur HTML, qui vous permet de définir des formulaires et d'interagir avec eux directement dans votre navigateur. Elle inclut également une extension Chrome pour un accès facilité.

- Boîte de discussion IAC'est l'option la plus simple pour les débutants, et je vous explique comment l'utiliser ci-dessous. Notez qu'il n'est pas nécessaire de souscrire au service Chatbox AI, qui est un abonnement permettant d'accéder à tous les modèles LLM sans avoir à installer Ollama.

-

Pour utiliser la meilleure interface Chatbox AI, rendez-vous sur Page de téléchargement Téléchargez la version pour votre Mac.

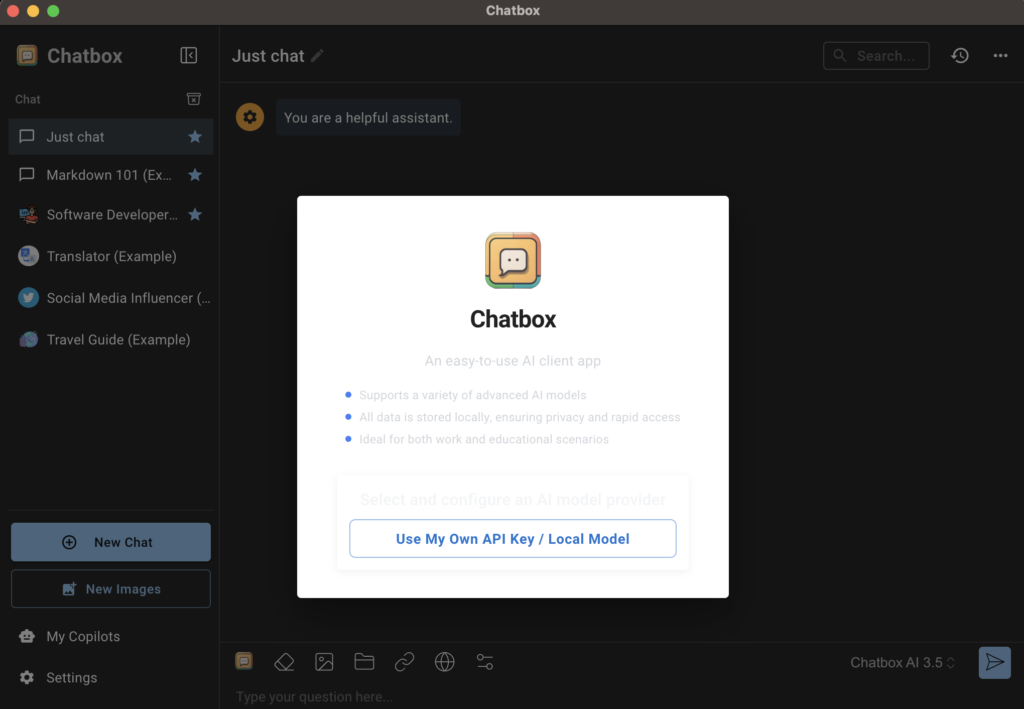

Ensuite, ouvrez le programme d'installation et exécutez-le. Sur le premier écran, une fenêtre contextuelle apparaîtra vous demandant comment utiliser Chatbox AI.

Vous devrez cliquer sur le bouton Utiliser ma propre clé API / modèle local.

Ensuite, appuyez sur API Ollama En tant que fournisseur de modèles d'intelligence artificielle.

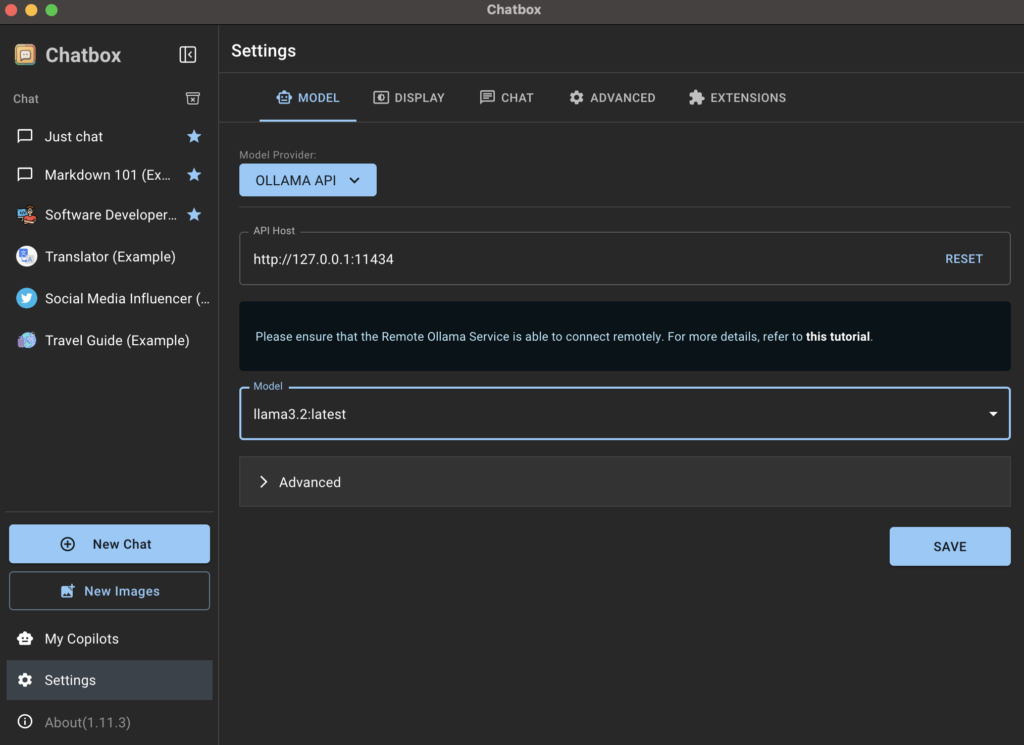

Chatbox AI devrait détecter automatiquement qu'Ollama est en cours d'exécution et définir l'hôte de l'API sur sa valeur par défaut, qui est Adresse IP de retour de boucle et numéro de port 11434Vous n'avez rien à modifier ici. Le formulaire devrait afficher les formulaires que vous avez installés précédemment via le Terminal. Dans mon cas, il s'agit du formulaire lama 3.2.

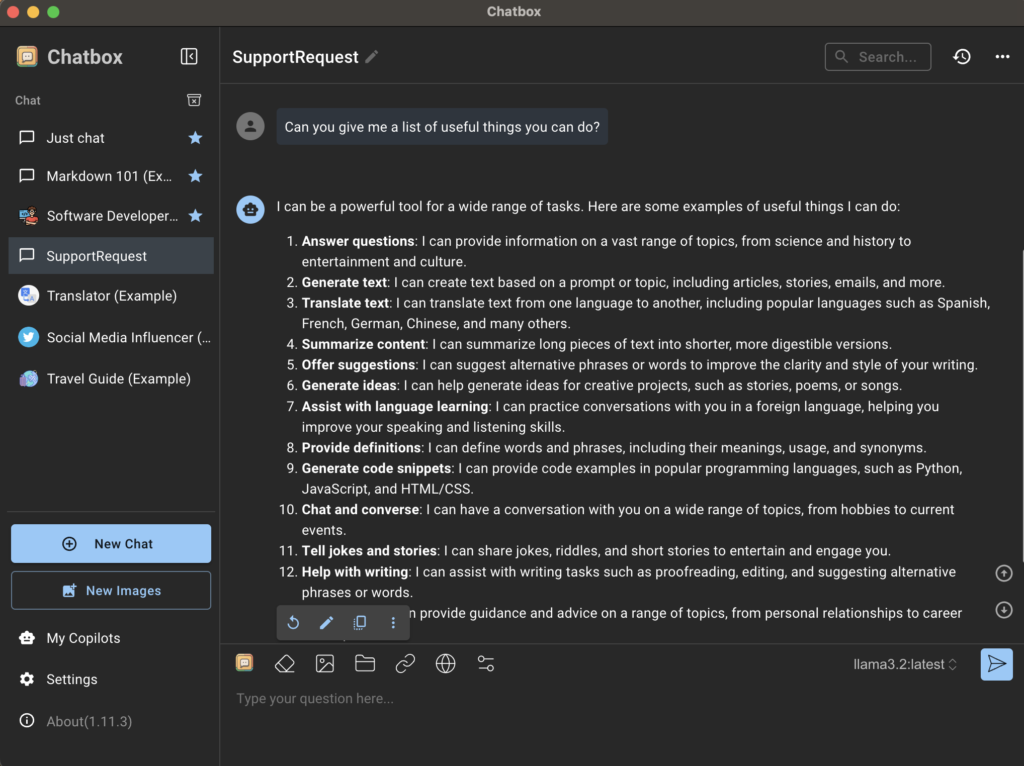

De retour sur la page d'accueil de l'application, cliquez sur Juste discuter ou Nouveau chat Assurez-vous de sélectionner le bon modèle en bas à droite. Vous pouvez le modifier à tout moment, mais je vous recommande de créer une nouvelle conversation pour chaque modèle utilisé afin de bien visualiser les différences.

Outils alternatifs pour exécuter localement des modèles LLM

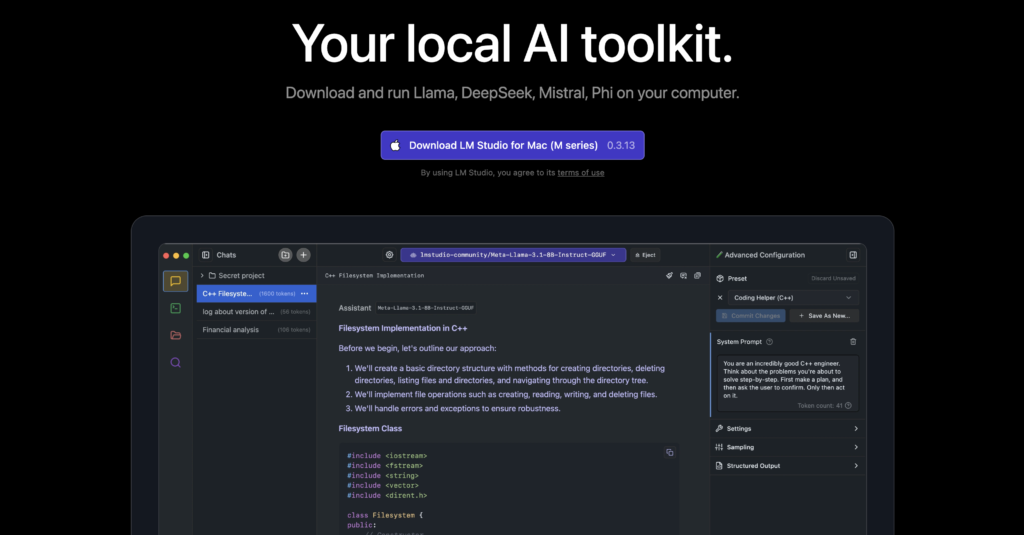

Si vous recherchez des alternatives à Ollama ou si vous préférez une expérience plus conviviale dès le départ, alors Studio LM Voici une autre excellente option. Son interface conviviale permet d'explorer et d'utiliser facilement différents modèles d'IA, et de les télécharger et de les exécuter sans difficulté. LM Studio est disponible pour Linux, Mac et Windows et propose des fonctionnalités telles que la personnalisation des paramètres des modèles et l'historique des conversations. Actuellement gratuit, je le recommande plutôt que le service d'abonnement Chatbox AI.

CONCLUSION

L'exécution locale de modèles de langage complexes (LLM) sur votre Mac est essentielle pour quiconque souhaite mieux contrôler ses applications d'IA et garantir la confidentialité des données. Grâce à des outils comme Ollama et aux interfaces graphiques mentionnées précédemment, qui facilitent l'intégration des LLM à votre flux de travail, vous pouvez exploiter pleinement et en toute sécurité le potentiel de votre productivité et de votre créativité.

Toutefois, le déploiement local d'un modèle LLM nécessite une certaine compréhension des paramètres et de leur impact sur les performances de ce modèle sur votre machine. Le meilleur moyen d'y parvenir est d'expérimenter avec différents modèles afin de déterminer ceux qui offrent les meilleurs résultats. Une fois ce concept assimilé, vous serez en mesure de choisir plus judicieusement les modèles à utiliser et d'optimiser leurs performances en fonction de vos besoins spécifiques.

Les commentaires sont fermés.