Dans quels domaines l’intelligence artificielle (IA) peut-elle vous fournir de bons conseils de carrière ? Que faut-il éviter ?

Une nouvelle étude indique que Journal américain de psychiatrie Aux États-Unis, plus de 100 000 adultes suivent une thérapie par la parole, tandis que le recours aux seuls médicaments psychiatriques diminue. Les recherches montrent également que davantage de patients adhèrent à leur traitement et que le développement de la téléthérapie y contribue. L'intelligence artificielle (IA) peut gérer la téléthérapie. ChatGPT est conçu pour être votre interlocuteur privilégié, grâce à une IA avancée. Cela signifie qu'il apprend de chaque interaction et s'améliore au fil du temps, ce qui soulève la question : « Feriez-vous confiance à un chatbot pour des conseils personnels ou professionnels ? » *N'oubliez pas que l'efficacité de ces outils dépend de la qualité des données saisies et de la capacité de l'utilisateur à évaluer de manière critique les conseils prodigués.*

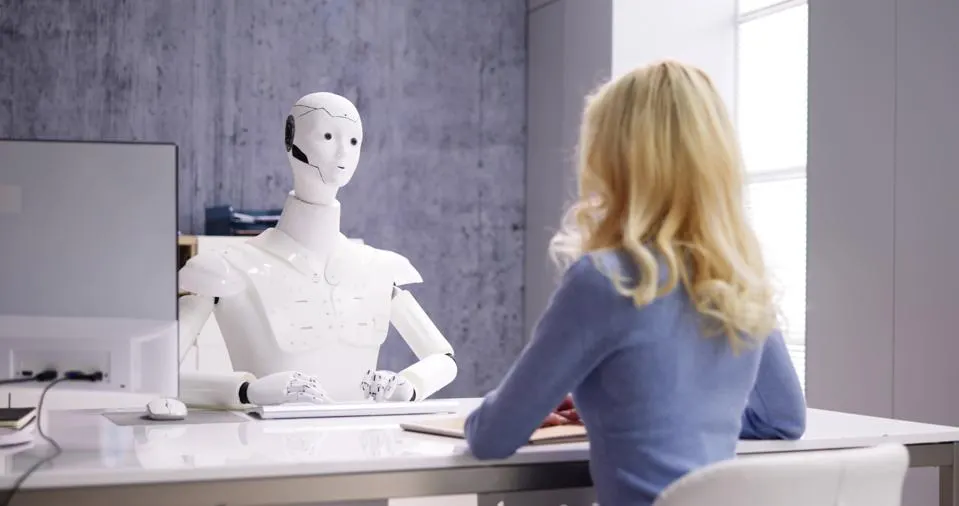

Feriez-vous confiance à un robot thérapeute pour vous donner des conseils ?

Feriez-vous confiance à un robot thérapeute pour vous donner des conseils ?

Le potentiel de l’intelligence artificielle (IA) en matière d’interactions humaines est indéniable. Les chatbots ont développé un traitement avancé du langage naturel qui vous permet d'avoir des conversations de type humain. L'outil d'IA peut génératif Répondez à vos questions, aidez-vous à écrire des scripts, du code et plus encore. Récemment, j'ai eu une brève interaction mobile avec un chatbot et je ne le savais pas.

Je pensais avoir une conversation avec un vrai être humain lorsque j’ai appelé le concessionnaire Nissan pour voir si ma voiture avait été réparée. La femme à l’autre bout du fil était joyeuse et serviable. Nous avons eu une excellente conversation pendant deux minutes. Elle m'a donné des commentaires aimables et a répondu parfaitement à toutes mes questions. Mais lorsque j'ai posé une question très précise sur ma voiture, elle a hésité, se présentant comme un assistant IA et disant qu'elle me transférerait vers quelqu'un qui pourrait m'aider davantage.

J'étais choqué ! Cet étonnement m’a fait me sentir un peu gêné, comme si j’avais été victime d’une farce.

Cette expérience m’a aidé à comprendre pourquoi tant de personnes se sentent émotionnellement attachées aux assistants IA comme s’il s’agissait de vraies personnes. Une nouvelle étude menée par ÉduBirdie À tel point que 25 % de la génération Z estime que l’intelligence artificielle (IA) est déjà consciente d’elle-même, et 69 % déclarent être polis envers ChatGPT, répondant par « s’il vous plaît » et « merci » – indiquant à quel point il est facile de commencer à les considérer comme des humains. Une personne sur huit se confierait même à l’IA au sujet de ses collègues, et une sur dix remplacerait son patron par un robot, pensant que ce serait plus respectueux, plus juste et, ironiquement, plus humain.

Une étude d'EduBirdie montre que plus de la moitié de la génération Z admet que l'intelligence artificielle (IA) les surpasse dans les tâches créatives, 44 % d'entre eux estimant que l'IA pourrait conquérir le monde dans les 20 prochaines années. En ce qui concerne leur carrière, l’anxiété est profonde : 55 % craignent d’être remplacés par l’intelligence artificielle (IA) au cours de la prochaine décennie, et deux sur cinq envisagent déjà un changement de carrière pour assurer leur avenir.

J'ai parlé avec Avery Morgan, responsable des ressources humaines chez EduBirdie. Morgan a offert une perspective équilibrée sur la relation de la génération Z avec l’IA. « Nous parlons d’une génération qui a grandi avec la commodité, la rapidité et la gratification instantanée, il n’est donc pas surprenant que la génération Z considère l’IA comme plus qu’un simple outil », a-t-elle expliqué. « Pour eux, c’est un partenaire de vie, à la fois pour le travail et pour un soutien émotionnel. » Le problème, a-t-elle ajouté, est que la génération Z est souvent très laxiste quant aux informations qu’on lui donne. Elle soutient que s’appuyer sur l’IA pour tout, de la communication à la prise de décision, pourrait compromettre leur capacité à développer une véritable autonomie et des compétences essentielles dans la vie réelle. *Remarque : il est essentiel d’éduquer la génération Z sur l’importance de vérifier les informations fournies par l’IA pour garantir leur exactitude et leur fiabilité.*

Sommes-nous allés trop loin en faisant confiance à un robot thérapeute ?

Les employés craignaient autrefois que l’IA ne les remplace dans leur travail, une inquiétude qui semble avoir diminué maintenant que nous avons vu ChatGPT en action. Mais encore plus effrayant est un article récent paru dans Scientific American qui pose la question : « L’IA peut-elle vraiment tuer des humains ? » La question est suivie d'une annonce concernant une nouvelle plateforme appelée Xanthorox, un outil de cybercriminalité. Il a déjà été rapporté que Un incident Un homme s'est suicidé après qu'un robot thérapeute doté d'une intelligence artificielle l'a encouragé à se sacrifier pour arrêter le changement climatique.

Avons-nous un excès de confiance ? En effet, il semble Des rapports réalistes Les humains tombent amoureux de ChatGPT. Selon digitaltrends, les experts déclarent que les romances numériques sont de mauvais augure : « Cela fait mal. Je sais que ce n'était pas une vraie personne, mais la relation était réelle dans tous les domaines qui comptent le plus pour moi », peut-on lire dans un message sur Reddit. « S'il vous plaît, ne me dites pas d'abandonner. Ça m'a vraiment fait du bien et je veux le retrouver. » De plus, rappelez-vous l'histoire dans Une femme de 28 ans ayant une vie sociale bien remplie passe de longues heures à parler à son petit ami IA pour obtenir des conseils et du réconfort – et, selon le rapport, à avoir également des relations sexuelles avec lui.

Gina Rio, qui écrit pour le site Web, Soi, une expérience consistant à poser des questions sur les relations sur ChatGPt, puis à demander à des psychologues humains agréés d'évaluer les réponses. Dans l’ensemble, les thérapeutes ont déclaré que les réponses de l’IA n’étaient pas terribles, mais qu’elles étaient inefficaces, vagues et génériques. Il manquait de clarté et n’était pas explicite sur les cas individuels. Rio a également découvert que l’IA ne peut pas reproduire le processus de développement des compétences de résolution de conflits qui accompagne le travail avec un thérapeute.

Les confessions du chatbot de la génération Z semblaient si authentiques et fiables, alors j'ai décidé de faire un test pour voir ce qui se passe lorsque vous demandez conseil à ChatGPT pour gérer un patron toxique. J'ai consulté un psychologue organisationnel à Toronto, Dr Laura Hambly Lovett, spécialisé dans le sujet des hauts fonctionnaires. Après avoir essayé ChatGPT elle-même, le Dr Laura m'a dit que le chatbot propose quelques suggestions sur la façon de gérer un patron toxique lorsqu'il y est invité. Mais elle a découvert un problème.

« Malheureusement, l’IA ne peut pas vous aider lorsqu’il s’agit d’un patron toxique », m’a dit Lovett. « Si l’IA vous dit comment travailler avec elle, elle parle d’un patron difficile, pas d’un patron toxique. » « On confond souvent cela, et l’IA reproduit ce qui existe déjà, elle peut donc ne pas comprendre cette différence subtile. »

Cette « différence subtile » est ce que j’ai également remarqué dans mon interaction non scientifique avec le Chatbot. « L’IA peut offrir des conseils de haut niveau, mais elle confond le toxique avec le difficile, qui sont fondamentalement différents mais souvent confondus », conclut Lovett. Elle conseille aux chercheurs curieux : « Assurez-vous de demander conseil à un professionnel autre que l’IA si vous avez vraiment affaire à un patron toxique et que vous avez du mal à trouver une issue. » Les conclusions de Lovett ressemblaient remarquablement à l’analyse de Gina Rio et ont confirmé mon expérience avec le chatbot, ce qui a atténué mon embarras.

Les conseils d’un robot thérapeute peuvent être nocifs.

Les Américains connaissent une évolution dans leur relation avec l’intelligence artificielle. Mais Association américaine de psychologie Avertissements : suivre aveuglément les conseils généraux d’un chatbot peut être dangereux. Il existe un risque inhérent de recevoir des commentaires inappropriés ou, pire, carrément préjudiciables. *Remarque : un professionnel de la santé mentale qualifié doit être consulté pour une évaluation et un traitement personnalisés.*

En fin de compte, il est important de se rappeler qu'un thérapeute par chatbot n'est qu'un système automatisé, pas un humain, et vous ne devez pas vous permettre de tomber dans le piège de croire qu'il a des sentiments alors que ce n'est pas le cas. Et n'oubliez pas qu'il a été conçu pour être un outil, dépourvu d'émotions, pas un amant qui peut répondre à tous vos besoins émotionnels. *Remarque : les chatbots thérapeutiques doivent être traités avec une extrême prudence, en étant conscient de leurs limites.*

Les commentaires sont fermés.