Les risques de l'IA d'entreprise : alternatives à OpenAI et institutions derrière les agents d'IA

Lacunes en matière de confidentialité des données, de conformité et de confiance dans les intégrations actuelles des agents d'IA

« Attendez… envoyez-vous vos écritures comptables à OpenAI ? »

C'est la première chose que mon amie m'a demandée quand je le lui ai montré. Ressentir-Écrire, une application de journalisation alimentée par l'IA que j'ai créée lors d'un hackathon à San Francisco.

J'ai haussé les épaules.

« C'était un hackathon sur le thème de l'IA, et je devais créer quelque chose rapidement. »

Elle n'a pas manqué un instant :

« Bien sûr. Mais comment puis-je me fier à ce que j'ai construit ? Pourquoi ne pas organiser votre propre LLM ? »

Cela m'a arrêté.

J’étais fier de la rapidité avec laquelle l’application a été créée. Mais cette question, et celles qui ont suivi, ont révélé tout ce que je pensais savoir sur la construction responsable avec l’IA. Les juges du hackathon l'ont également mentionné.

Ce moment m’a fait réaliser à quel point nous sommes irrespectueux lorsque nous construisons avec l’IA, en particulier avec des outils qui traitent des données sensibles.

J'ai réalisé quelque chose de plus grand :

Nous ne parlons pas assez de confiance lorsque nous construisons avec l’IA.

Sa réponse m’est restée en tête. Georgia von Minden est spécialiste des données à l'ACLU, où elle travaille en étroite collaboration sur les questions liées aux informations personnelles identifiables dans les contextes juridiques et des droits civils. J’ai toujours apprécié sa perspicacité, mais cette conversation était différente.

Alors je lui ai demandé de m'expliquer. Que signifie réellement la confiance dans ce contexte ? Surtout lorsque les systèmes d’IA traitent des données personnelles.

Elle m'a dit :

La confiance peut être difficile à établir, mais la gouvernance des données est un bon point de départ. La propriété des données, leur mode de stockage et leur utilisation sont des éléments importants. Il y a dix ans, j'aurais répondu différemment à cette question. Mais aujourd'hui, avec une puissance de calcul colossale et des entrepôts de données immenses, l'inférence à grande échelle est une réelle préoccupation. OpenAI dispose d'un accès si étendu aux données et au calcul que son manque de transparence incite à la prudence.

En matière d'informations personnelles identifiables (IPI), la réglementation et le bon sens soulignent la nécessité d'une gouvernance rigoureuse des données. L'envoi d'informations personnelles identifiables via des appels API est non seulement risqué, mais peut également enfreindre ces règles et mettre en danger des personnes.

Cela m’a rappelé que lorsque nous construisons avec l’IA, en particulier des systèmes qui traitent des données humaines sensibles, nous n’écrivons pas seulement du code.

Nous prenons des décisions concernant la confidentialité, l’autorité et la confiance.

Dès que vous collectez des données utilisateur, en particulier des données personnelles comme des entrées de journal, vous entrez dans un espace de responsabilité. Il ne s’agit pas seulement de ce que votre modèle peut faire. Il s’agit de ce qui arrive à ces données, où elles vont et qui y a accès. La gestion responsable des données des utilisateurs augmente la confiance des utilisateurs et améliore la confidentialité.

L'illusion de la simplicité

Aujourd’hui, il est plus facile que jamais de lancer quelque chose qui a l’air intelligent. Avec de grands modèles de langage (LLM) comme OpenAI et d’autres, les développeurs peuvent créer des outils d’IA en quelques heures. Les startups peuvent lancer des fonctionnalités « alimentées par l’IA » du jour au lendemain. Et les institutions ? Elle s’empresse d’intégrer ces agents dans son flux de travail.

Mais dans toute cette excitation, une chose est souvent négligée : Confiance.

Quand les gens parlent de Agents IAIls font souvent référence à de simples wrappers autour de grands modèles de langage (LLM). Ces agents peuvent répondre à des questions, automatiser des tâches ou même prendre des décisions. Mais beaucoup d’entre eux sont construits à la hâte, sans accorder beaucoup d’attention à la sécurité, à la conformité ou à la responsabilité.

Utilisez simplement le produit pour OpenAI Cela ne veut pas dire que c'est sûr. Ce à quoi vous faites réellement confiance, c'est à l'ensemble du pipeline :

- Qui a construit la couverture ?

- Comment vos données sont-elles traitées ?

- Vos informations sont-elles stockées, enregistrées – ou pire, divulguées ?

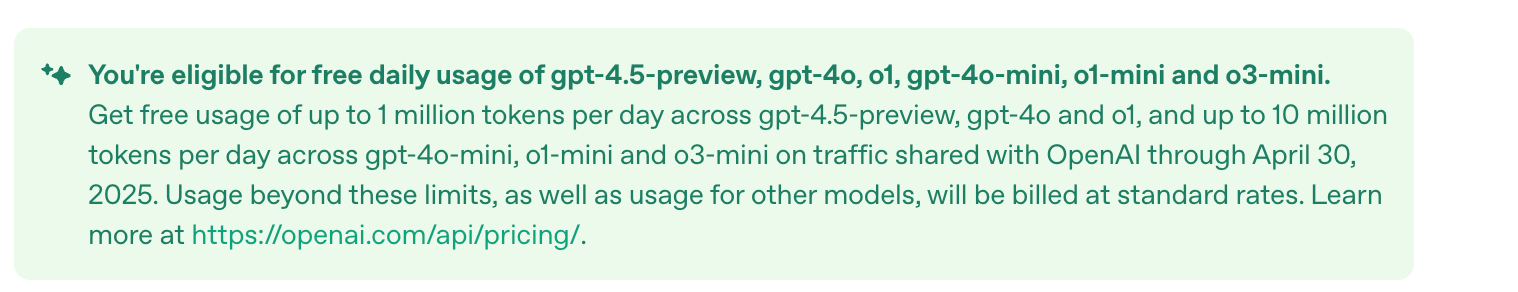

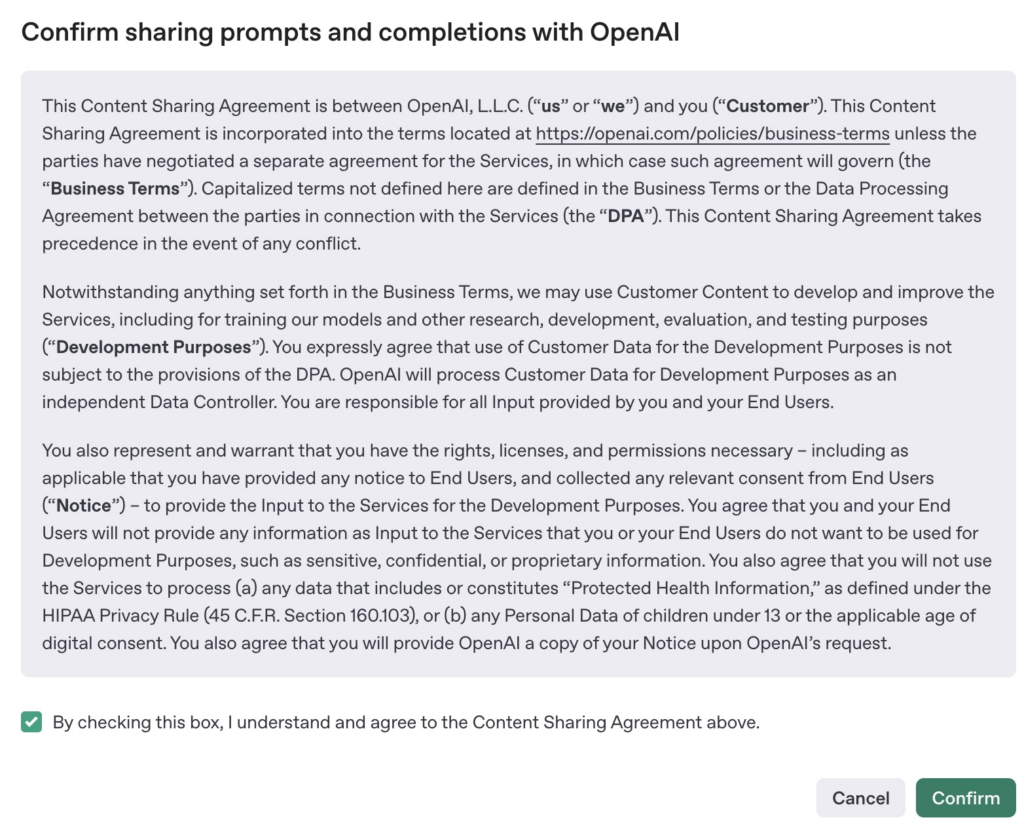

J'utilise moi-même l'API d'OpenAI pour les cas d'utilisation des clients. Récemment, on m’a offert un accès gratuit à l’API – jusqu’à 1 million de jetons par jour jusqu’à fin avril – Si j'accepte de partager mes données de réclamation.

J'ai failli accepter pour un projet personnel, mais ensuite, une idée m'est venue : si un fournisseur de solutions acceptait le même accord pour réduire les coûts, ses utilisateurs n'auraient aucune idée que leurs données étaient partagées. Sur le plan personnel, cela peut sembler inoffensif. Mais dans le contexte de l’institution ? Il s’agit d’une violation grave de la vie privée et éventuellement d’obligations contractuelles ou réglementaires.

Il suffit qu’un ingénieur dise « oui » à un accord comme celui-ci, et vos données client seront entre les mains de quelqu’un d’autre.

L'IA d'entreprise suscite des attentes

Je vois de plus en plus d'entreprises SaaS et de startups d'outils de développement expérimenter des agents d'IA. Certaines obtiennent de bons résultats, certains permettant aux utilisateurs d'utiliser leurs propres modèles de langage étendus (LLM), leur donnant ainsi le contrôle sur l'emplacement d'exécution du modèle et le traitement des données. C'est une approche judicieuse, d'autant plus que l'IA prend une place croissante dans l'entreprise.

Voici l’approche réfléchie : Vous définissez les limites de confiance..

Mais tout le monde n’est pas aussi enthousiaste.

De nombreuses entreprises se connectent simplement à l'API d'OpenAI, ajoutent quelques boutons et l'appellent « prêt pour l'entreprise ».

Attention : ceci n'est pas vrai.

Qu'est-ce qui pourrait mal se passer ? beaucoup.

Si vous intégrez des agents d’IA dans votre infrastructure sans poser les questions difficiles, voici les risques potentiels :

- Fuite de donnéesVos réclamations peuvent inclure des données client sensibles, des clés API ou une logique interne. Si elles sont soumises à un formulaire tiers, elles peuvent être exposées.

En 2023, les ingénieurs de Samsung ont collé par inadvertance du code source interne et des notes dans ChatGPT (Forbes). Ces données pourraient désormais faire partie de futurs ensembles de formation, ce qui représente un risque important en matière de propriété intellectuelle.

- Violations de conformitéLa soumission d'informations personnelles identifiables (PII) via un formulaire comme OpenAI sans contrôles appropriés pourrait violer le règlement général sur la protection des données (RGPD), la loi HIPAA ou vos contrats.

La société X d’Elon Musk l’a appris à ses dépens. Ils ont lancé leur chatbot IA, « Grok », en utilisant tous les messages des utilisateurs, y compris ceux des utilisateurs de l'UE, pour le former, sans l'abonnement approprié. Les organisateurs sont rapidement intervenus. Sous la pression, ils ont arrêté de former Grok dans l'Union européenne (Politico).

- comportement vagueLes agents non déterministes sont difficiles à corriger ou à expliquer. Que se passe-t-il lorsqu'un client demande pourquoi un chatbot a fait une mauvaise recommandation ou a révélé quelque chose de confidentiel ? Vous avez besoin de transparence pour répondre à cette question – et de nombreux agents aujourd’hui ne la fournissent pas.

- Confusion autour de la propriété des donnéesÀ qui appartient le produit ? Qui enregistre les données ? Le prestataire de services se recycle-t-il sur vos intrants ?

Zoom a été surpris en train de faire exactement cela en 2023. Ils ont discrètement modifié leurs conditions de service pour permettre l'utilisation des données des réunions clients pour former l'IA (Fast Company). Après une réaction publique négative, ils ont inversé leur politique, mais cela a rappelé que la confiance peut être perdue du jour au lendemain.

- Défauts de sécurité dans l'emballageEn 2024, des dizaines de déploiements de Flowise – un outil d’orchestration LLM low-code populaire – ont été découverts exposés sur Internet, beaucoup sans authentification (Actualités cybersécurité). Les chercheurs ont découvert des clés API, des informations d’identification de base de données et des données utilisateur en accès libre. Ce n’est pas le problème d’OpenAI – c’est un problème. Constructeurs. Mais ce sont toujours les utilisateurs finaux qui en paient le prix.

- Des fonctionnalités d'IA qui vont trop loinLa fonctionnalité « Rappel » de Microsoft, qui fait partie de son déploiement Copilot, capture automatiquement des captures d'écran de l'activité des utilisateurs pour aider l'assistant IA à répondre aux questions (DoublePulsar). Cela semblait utile… jusqu’à ce que les experts en sécurité le signalent comme un cauchemar en matière de confidentialité. Microsoft a dû rapidement revenir en arrière et rendre cette fonctionnalité uniquement facultative.

Tout n’a pas besoin d’OpenAI.

OpenAI est une plateforme incroyablement puissante. Mais ce n’est pas toujours la meilleure solution.

Parfois, un modèle local plus petit est tout à fait suffisant. D’autres fois, la logique basée sur des règles fait mieux l’affaire. L’option la plus sûre est souvent celle qui fonctionne entièrement au sein de votre propre infrastructure, selon vos règles.

Nous ne devrions pas simplement intégrer aveuglément un grand modèle de langage (LLM) et l’appeler un « assistant intelligent ».

Dans les institutions, La confiance, la transparence et le contrôle ne sont pas des options. - C'est plutôt essentiel.

Il existe un nombre croissant de plateformes permettant ce type de contrôle. Einstein 1 Studio de Salesforce prend désormais en charge cette fonctionnalité apportez votre propre modèle, vous permettant de connecter votre grand modèle de langage (LLM) depuis AWS ou Azure. IBM Watson permet aux organisations de déployer des modèles en interne avec des pistes d’audit complètes. Avec MosaicML, Databricks vous permet de former des modèles de langage privés de grande taille (LLM) au sein de votre propre cloud, afin que vos données sensibles ne quittent jamais votre infrastructure.

Voilà à quoi devrait ressembler une véritable IA d’entreprise.

CONCLUSION

Les agents d'IA sont incroyablement puissants, permettant des flux de travail et une automatisation que nous ne pouvions pas réaliser auparavant. Cependant, la facilité de développement ne signifie pas nécessairement la sécurité, en particulier lorsqu’il s’agit de données sensibles à grande échelle.

Avant de commencer à utiliser ce nouvel agent brillant, posez-vous la question suivante :

- Qui contrôle le modèle ?

- Où vont les données ?

- Sommes-nous conformes à la réglementation ?

- Pouvons-nous vérifier ce qu'il fait ?

À l’ère de l’intelligence artificielle, la plus grande menace n’est pas la mauvaise technologie, mais Confiance aveugle.

A propos de l'auteur

Je suis Ellen, ingénieure en apprentissage automatique avec 6 ans d'expérience, travaillant actuellement dans une startup fintech à San Francisco. Mon expérience couvre des rôles de science des données dans le conseil en pétrole et gaz, ainsi que la direction de programmes de formation en IA et en données en Asie-Pacifique, au Moyen-Orient et en Europe.

Je termine actuellement mon Master en science des données (diplôme en mai 2025) et je recherche activement ma prochaine opportunité en tant qu'ingénieur en apprentissage automatique. Si vous êtes ouvert à une recommandation ou à une connexion, je vous en serais vraiment reconnaissant !

J'aime avoir un réel impact sur le monde grâce à l'IA et je suis toujours ouvert aux collaborations basées sur des projets.

Les commentaires sont fermés.