Mon expérience personnelle : exécuter un chatbot IA réel localement sur un iPhone

Chatbots alimentés par l'IA, tels que : ChatGPT et GEMINI…de s'appuyer sur le cloud computing pour fonctionner. Et si vous pouviez exécuter un modèle de langage à grande échelle (LLM) directement sur votre iPhone, sans abonnement, sans connexion internet, ni même sans que vos données ne quittent l'appareil ? Grâce à une suite d'applications et de modèles légers et compacts, c'est déjà possible.

Je l'ai essayé moi-même, et voici ce que vous devez savoir.

Exécuter l'IA localement sur iPhone

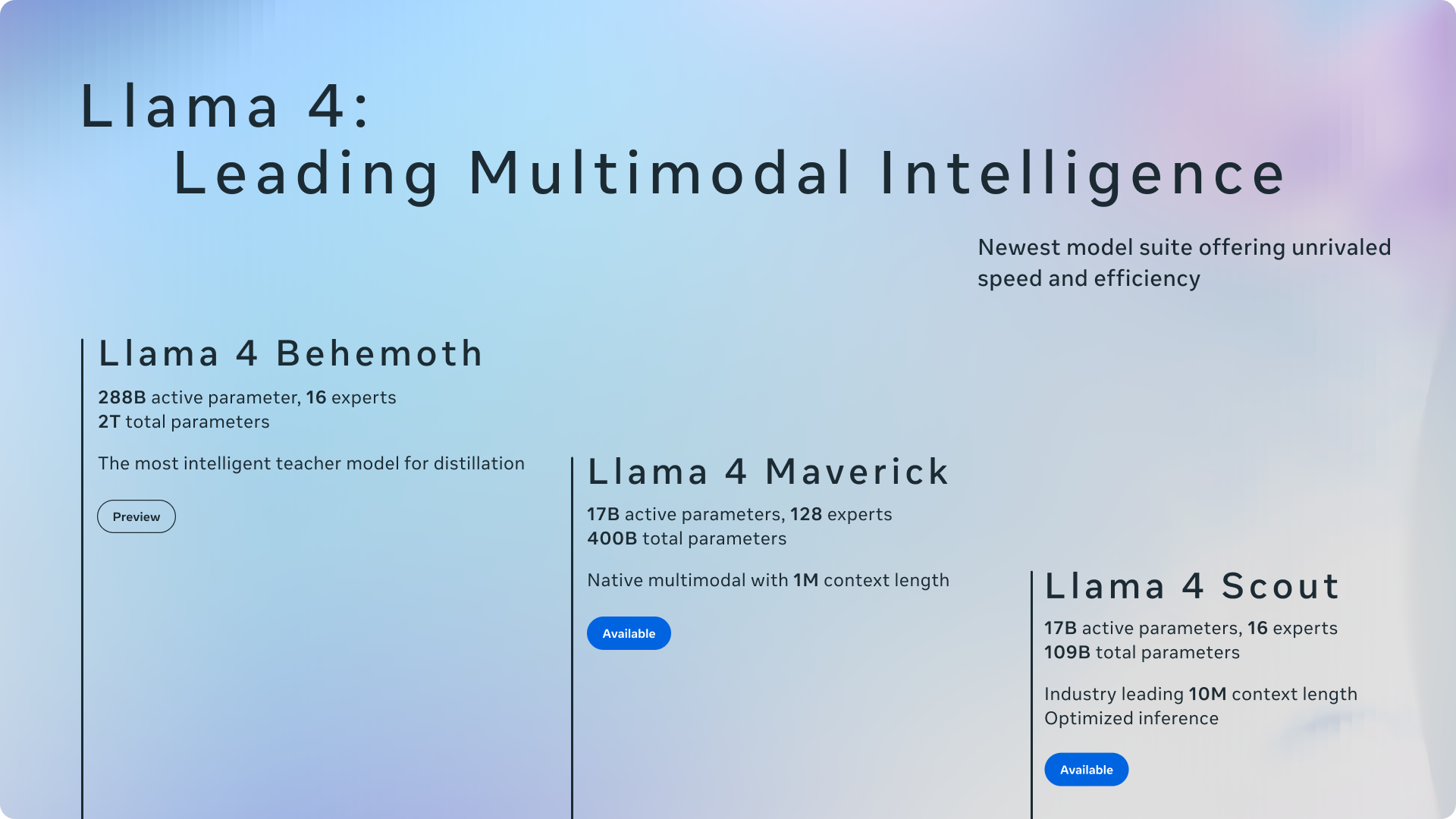

Vous pouvez désormais exécuter des modèles open source comme Flamme et Qwen Directement sur iOS. Ces modèles sont réduits grâce à un processus appelé quantification, qui les compresse pour les adapter à la mémoire mobile sans impact significatif sur les performances.

Mais il y a un point important : les performances dépendent fortement de votre appareil. Par exemple, l'iPhone 15 Pro ou 15 Pro Max, équipé de la dernière puce d'Apple, peut exécuter des modèles avec jusqu'à 7 ou 8 milliards de paramètres (comme le Llama 3.1 8B), tandis que les téléphones plus anciens sont plus adaptés à des modèles plus petits avec des paramètres compris entre 1 et 3 milliards.

Des applications qui rendent cela possible

- LLM Farm (gratuit) : Le moyen le plus simple de démarrer. Vous pouvez télécharger un petit modèle (comme Phi-3.5 Instruct) et l'exécuter hors ligne en un seul clic. C'est étonnamment fluide pour les requêtes rapides.

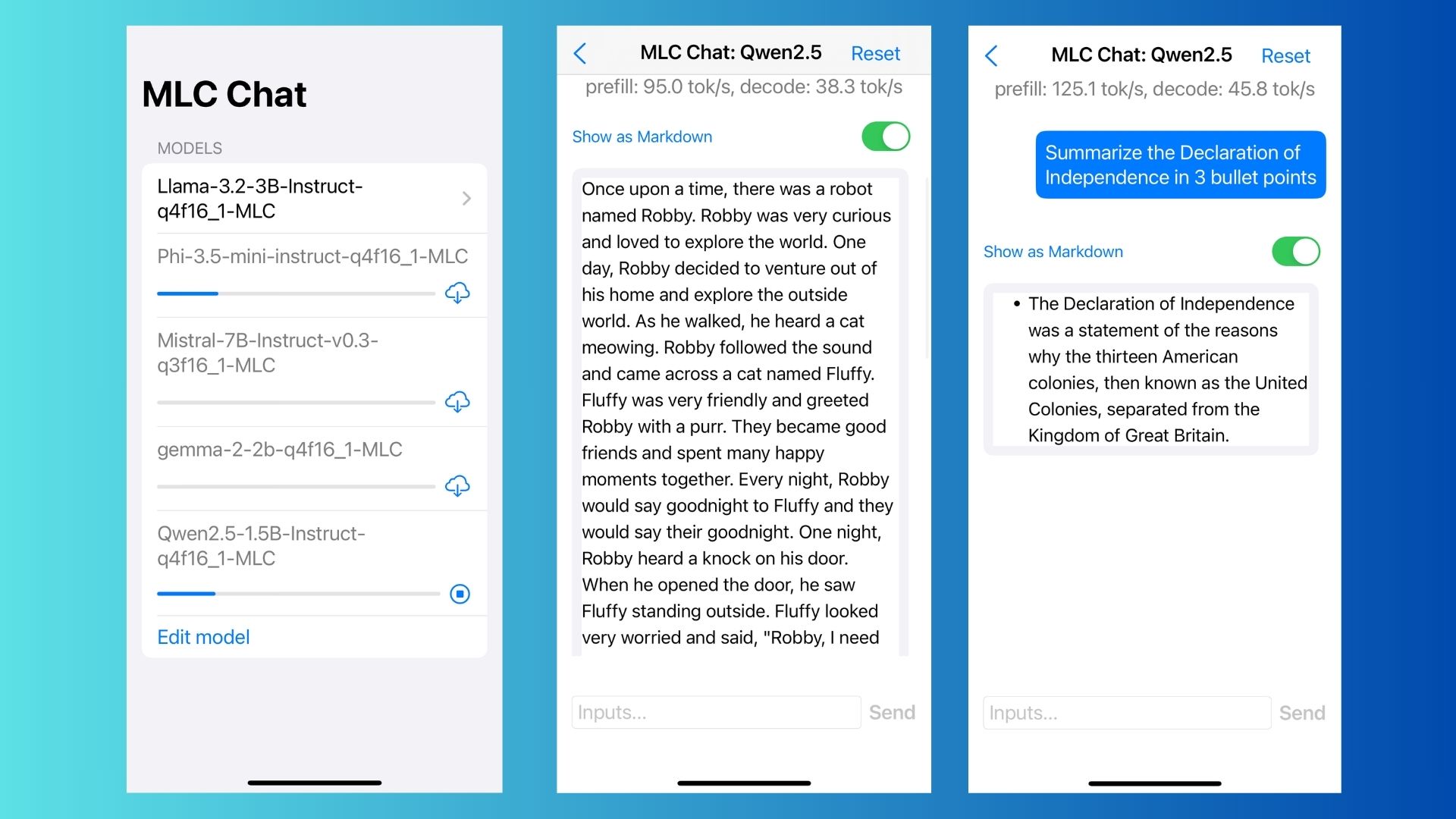

- Chat MLC (gratuit) :

Voici l'application que j'ai utilisée. Je voulais essayer LLM Farm, mais pour une raison inconnue, elle n'était pas disponible en téléchargement sur l'App Store d'Apple. Comme elle est gratuite, je l'ai essayée et elle a parfaitement fonctionné. - LLM privé (projet communautaire) : Cette option est davantage un projet DIY que pour l'utilisateur lambda. Cette application inclut des guides détaillés pour télécharger des modèles comme Llama 3.1 et Qwen sur votre iPhone. Si vous aimez bricoler et expérimenter, elle vaut vraiment le détour.

- Apollo (payant) : J'en ai entendu du bien, mais je ne l'ai pas encore testée. Dites-moi dans les commentaires ce que vous pensez de cette application axée sur la confidentialité.

Comment exécuter le modèle localement

Après avoir téléchargé l'application de votre choix, ouvrez-la. Parcourez ensuite la liste des modèles intégrés et sélectionnez-en un (par exemple, Phi-3.5 Instruct Q4 quantifié). J'ai choisi Qwen 2.5 pour la simple raison que je ne l'avais pas utilisé depuis un moment.

Une fois téléchargé, le formulaire s'affichera sur votre appareil (sa taille varie de quelques centaines de mégaoctets à plusieurs gigaoctets). Ensuite, commencez simplement à discuter.

Soyez réaliste ; ce n'est pas le moment de demander des analyses approfondies ou des plans longs et détaillés. Tenez compte des points suivants :

- Vitesse: Les petits modèles (1 à 3 milliards de paramètres) répondent plus rapidement, tandis que les grands modèles peuvent prendre quelques secondes par symbole.

- Contexte: Ne collez pas des articles entiers ; gardez les invites plus courtes.

- Sortir: Les modèles de langage locaux de grande taille peuvent être moins précis que ChatGPT, mais ils sont utiles pour la prise de notes, les résumés, les questions-réponses et la rédaction légère.

J'ai pris plaisir à tester certaines invites. Rien de compliqué ; je voulais juste voir le type de réponses que j'obtenais à la requête locale. Vous remarquerez immédiatement la rapidité. C'est incroyable la rapidité avec laquelle un grand modèle de langage répond.

J’ai essayé les affirmations suivantes et dans l’ensemble, j’ai aimé les résultats.

- Résumez la Déclaration d’Indépendance en trois points.

- « Écrivez une courte histoire pour le coucher sur un robot et un chat. »

- « Donnez-moi trois idées de dîner avec du poulet, du riz et du brocoli. »

Exécuter un grand modèle de langue locale n’est pas la même chose que discuter avec ChatGPT-5Cela semble certes simpliste et brut. Si vous essayez cette méthode, veillez à ce que vos invites soient courtes, car les fenêtres contextuelles sont beaucoup plus limitées qu'avec la version classique du chatbot. Vous aurez l'impression que les réponses sont plus lentes si vous surchargez le modèle de langage local.

Pourquoi ferais-tu ça ?

- Il n'y a pas de frais d'abonnement. Vous n’avez pas besoin de dépenser tout votre crédit juste pour essayer.

- Confidentialité intégrée. Tout reste sur votre propre appareil.

- Étonnamment polyvalent. J'ai été vraiment impressionné par la quantité de tâches que la figurine pouvait accomplir. Chaque fois que je testais ses limites, elle relevait le défi avec aisance.

La ligne du bas

Si vous possédez un iPhone 15 ou ultérieur et souhaitez explorer l'IA de l'intérieur, commencez par là. Ferme LLM ou Chat MLC Des moyens rapides et gratuits pour démarrer. Si vous vous souciez de votre vie privée, l'application Apollo Ça vaut le coup d'essayer. Si vous aimez l'expérimentation et la personnalisation, LLM privé Vous permet d'approfondir les paramètres personnalisés.

N'oubliez pas qu'il ne s'agit pas des chatbots puissants auxquels vous êtes habitués ; ne vous attendez donc pas à un résultat similaire à celui de ChatGPT. Mais c'est plutôt cool et futuriste d'exécuter votre propre IA sur votre iPhone.

Les commentaires sont fermés.