Comment l'IA réécrit les tâches quotidiennes des data scientists

De l'élimination des tâches à faible valeur ajoutée à l'accélération des projets à fort impact, voici comment l'IA remodèle les flux de travail de la science des données.

Dans mes articles précédents, j'ai exploré et comparé plusieurs outils d'IA, par exemple, Data Science Agent de Google, ChatGPT vs. Claude vs. Gemini Pour la science des données et Recherche profonde V3, etc. Cependant, il ne s'agit là que d'un petit sous-ensemble de tous les outils d'IA disponibles pour Sciences des données. Par exemple, certains des outils que j’ai utilisés dans mon travail :

- API OpenAI:Je l'utilise pour catégoriser et résumer les commentaires des clients et identifier les faiblesses des produits.

- ChatGPT et GEMINIIls m'aident à rédiger des messages et des e-mails Slack, à rédiger des rapports d'analyse et même des évaluations de performance.

- Glaner l'IA:Glean a utilisé l'IA pour trouver rapidement des réponses dans des documents et des communications internes.

- Curseur et Copilote: J'aime simplement appuyer sur Tab-Tab pour compléter automatiquement le code et les commentaires.

- Magie HexagonaleJ'utilise Hex pour les feuilles de calcul collaboratives au travail. Il offre également une fonctionnalité appelée Magie Hexagonale Écrire du code et corriger des bugs à l'aide de l'IA conversationnelle.

- Cortex de flocon de neigeCortex AI permet aux utilisateurs d'invoquer des points de terminaison LLM, de créer des RAG et des services texte-SQL à l'aide de données dans Snowflake.

Je suis sûr que vous pourriez allonger cette liste, et de nouveaux outils d'IA apparaissent chaque jour. Il est presque impossible d'en dresser une liste exhaustive à ce stade. Dans cet article, j'aimerais donc prendre du recul et me concentrer sur une question plus vaste : De quoi avons-nous réellement besoin en tant que professionnels des données et comment l’IA peut-elle nous aider ?؟

Dans la section ci-dessous, je me concentrerai sur deux tendances principales : l’élimination des tâches à faible valeur ajoutée et l’accélération du travail à haute valeur ajoutée.

1. Éliminez les tâches à faible valeur ajoutée

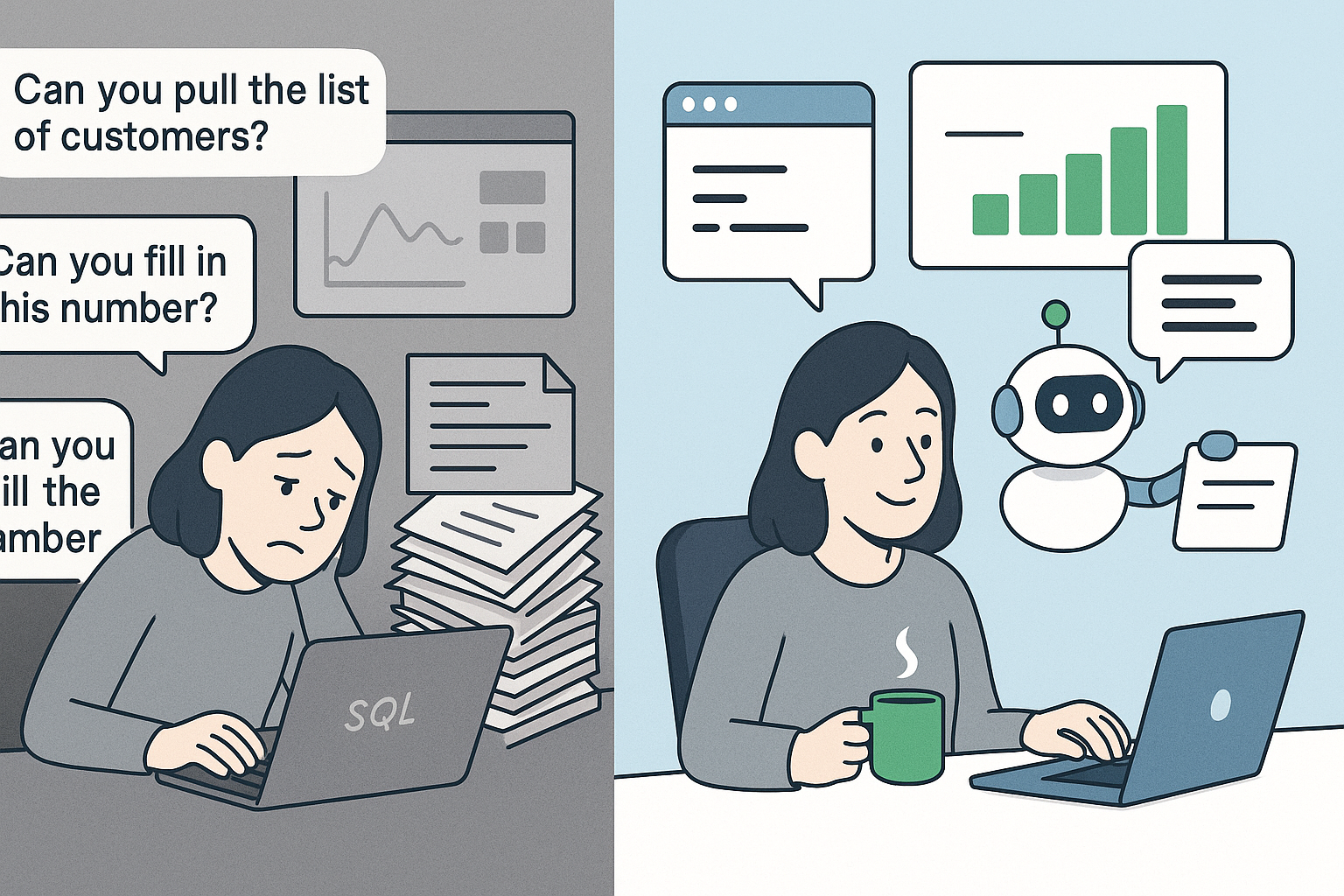

Je suis devenu data scientist parce que j'aime vraiment découvrir des informations commerciales à partir de données complexes et prendre des décisions commerciales sur la base de celles-ci. Cependant, après avoir travaillé dans ce domaine pendant plus de 7 ans, je dois admettre que tout le travail n’est pas aussi passionnant que je l’espérais. Avant de pouvoir effectuer des analyses avancées ou créer des modèles d’apprentissage automatique, de nombreux flux de travail à faible valeur ajoutée sont inévitables au quotidien. Dans de nombreux cas, cela est dû au fait que nous ne disposons pas des outils adéquats pour permettre à nos parties prenantes de bénéficier d’analyses en libre-service. Jetons un œil à notre situation actuelle et au cas idéal :

Statut actuel : Nous agissons en tant qu'interprètes et gardiens de données (parfois « singes SQL »)

- Demandes d'extraction de données simples Elle vient me voir, ainsi que mon équipe, sur Slack chaque semaine pour me demander : « Quelle était votre valeur brute des marchandises (VMB) le mois dernier ? » « Pouvez-vous dresser une liste de clients qui répondent à ces critères ? » « Pouvez-vous m’aider à remplir ce numéro pour la présentation que je dois faire demain ? »

- Les outils de Business Intelligence (BI) ne prennent pas bien en charge les cas d’utilisation en libre-service.. Nous avons adopté des outils de veille économique tels que Looker et Tableau afin que les parties prenantes puissent facilement explorer les données et surveiller les indicateurs. Mais la vérité est qu’il y a toujours un compromis entre la simplicité et la capacité de se servir soi-même. Parfois, nous créons des tableaux de bord faciles à comprendre avec quelques métriques, mais ils ne peuvent servir que quelques cas d'utilisation. Dans le même temps, si nous rendons l’outil hautement personnalisable avec la possibilité d’explorer librement les métriques et les données sous-jacentes, les parties prenantes peuvent trouver l’outil déroutant et manquer de confiance pour l’utiliser, et dans le pire des cas, les données peuvent être extraites et mal interprétées.

- Les documents sont peu nombreux ou obsolètes.. Il s’agit d’une situation courante, mais elle peut être causée par diverses raisons : peut-être que nous avançons rapidement et que nous nous concentrons sur l’obtention de résultats, ou qu’il n’existe pas de bonnes politiques de documentation des données et de gouvernance. En conséquence, les connaissances tribales deviennent un goulot d’étranglement pour les personnes extérieures à l’équipe de données qui souhaitent utiliser les données.

Cas idéal : permettre aux parties prenantes de se servir elles-mêmes afin de réduire le travail à faible valeur ajoutée

- Les parties prenantes peuvent effectuer des extractions de données simples et répondre à des questions de données de base avec facilité et confiance.

- Les équipes de données passent moins de temps à préparer des rapports répétitifs ou des requêtes ponctuelles de base.

- Les tableaux de bord sont détectables, interprétables et exploitables sans assistance directe.

Alors, pour se rapprocher de l’état idéal, quel rôle l’IA peut-elle jouer ici ? D'après ce que j'ai observé, voici les tendances communes vers lesquelles se dirigent les outils d'IA pour combler le fossé :

- Requête de données en langage naturel (Text-to-SQL)Une façon de réduire la barrière technique est de permettre aux parties prenantes d’interroger les données en langage naturel. Il existe de nombreux efforts de conversion de texte en SQL dans l’industrie :

- Par exemple, Flocon C'est l'une des entreprises qui a réalisé beaucoup de progrès dans Modèles Text2SQL Et a commencé à intégrer cette capacité dans son produit.

- De nombreuses entreprises (dont la mienne) ont également exploré les solutions Text2SQL en interne. Par exemple, j'ai participé Uber Son voyage avec QueryGPT d'Uber Pour faciliter l’interrogation des données pour son équipe opérationnelle. Cet article détaille comment Uber a conçu une architecture multi-agents pour générer des requêtes. Dans le même temps, il a également révélé des défis importants dans ce domaine, notamment l’interprétation précise de l’intention de l’utilisateur, la gestion de grands graphiques de tableau, l’évitement des hallucinations, etc.

- Franchement, pour que Text-to-SQL fonctionne, il y a un niveau très élevé où vous devez rendre la requête précise – même si l'outil échoue une seule fois, cela peut détruire la confiance et finalement les parties prenantes reviendront vers vous pour valider les requêtes (et ensuite vous devez lire + réécrire les requêtes, ce qui double presque le travail 🙁). Jusqu'à présent, je n'ai pas trouvé de modèle ou d'outil Text-to-SQL qui fonctionne parfaitement. Je pense que cela n'est réalisable que lorsque vous interrogez un très petit sous-ensemble d'ensembles de données sous-jacents bien documentés pour des cas d'utilisation spécifiques et standardisés, mais il est très difficile de le faire évoluer pour inclure toutes les données disponibles et différents scénarios commerciaux.

- Mais bien sûr, compte tenu de l’investissement massif dans ce domaine et du développement rapide de l’IA, je suis sûr que nous nous rapprocherons de plus en plus de solutions Text-to-SQL précises et évolutives.

- Assistant de Business Intelligence (BI) basé sur le chatUn autre domaine populaire pour améliorer l’expérience des parties prenantes avec les outils BI est un assistant BI basé sur le chat. En fait, cela va encore plus loin que Text-to-SQL : au lieu de générer une requête SQL basée sur l'invite de l'utilisateur, il répond dans un format de visualisation ainsi que dans un résumé textuel.

- Gémeaux en Looker Il est un exemple ici. Looker appartient à Google, il était donc naturel pour eux de s'intégrer à Gemini. Un autre avantage de Looker pour la création de son IA est que les champs de données sont déjà documentés dans la couche sémantique LookML, avec des mappages communs définis et des métriques communes incluses dans les tableaux de bord. Il y a donc beaucoup de données intéressantes à exploiter. Gemini permet aux utilisateurs de personnaliser les tableaux de bord Looker, de poser des questions sur les données et même de créer des agents de données personnalisés pour l'analyse conversationnelle. Bien que basé sur mon expérience limitée avec l'outil, il finit souvent par ne pas répondre même à des questions simples. Faites-moi savoir si vous avez une expérience différente et si vous y êtes parvenu…

- Tableau a également lancé une fonctionnalité similaire, Tableau IA. Je ne l'ai pas utilisé moi-même, mais d'après la démo, il aide l'équipe de données à préparer les données, à créer rapidement des tableaux de bord en langage naturel et à résumer les informations sur les données dans Tableau Pulse pour que les parties prenantes puissent facilement identifier les changements de métriques et les tendances anormales.

- Outils d'indexation de donnéesL’IA peut également aider à surmonter le défi d’avoir peu ou pas de documentation de données.

- Lors d'un hackathon interne, je me souviens qu'un des projets de nos ingénieurs de données consistait à utiliser LLM pour augmenter la couverture de la documentation des tables. L'IA est capable de lire la base de code et de décrire les colonnes en conséquence avec une grande précision dans la plupart des cas, ce qui peut aider à améliorer rapidement la documentation avec une validation et des modifications humaines limitées.

- De même, lorsque mon équipe crée de nouvelles tables, nous avons commencé à demander à Cursor d'écrire des fichiers YAML pour la documentation des tables afin de nous faire gagner du temps avec une sortie de haute qualité.

- Il existe également de nombreux catalogues de données et outils de gouvernance qui ont été intégrés à l’IA. Lorsque je recherche « index de données AI » sur Google, je vois des logos d'outils d'indexation de données comme Atlan, Alation, Collibra, Informatica, etc. (Avertissement : je n'en ai utilisé aucun). Il s’agit d’une tendance claire du secteur.

2. Accélérer le travail à haute valeur ajoutée

Maintenant que nous avons parlé de la manière dont l’IA peut aider à éliminer les tâches à faible valeur ajoutée, discutons de la manière dont elle peut accélérer les projets de données à forte valeur ajoutée. « Travail à haute valeur ajoutée » fait ici référence aux projets de données qui combinent l’excellence technique avec le contexte commercial et produisent un impact significatif grâce à une collaboration interfonctionnelle. Par exemple, une analyse approfondie qui comprend les modèles d’utilisation des produits et conduit à des changements de produits, ou un modèle de prédiction du taux de désabonnement des clients pour identifier les clients à risque de désabonnement et aboutir à des initiatives de prévention du désabonnement. Comparons la situation actuelle avec le futur idéal :

État actuel : Il y a des goulots d'étranglement dans Productivité Dans le flux de travail quotidien

- L’analyse exploratoire des données (EDA) prend du temps.. Cette étape est essentielle pour obtenir une compréhension initiale des données, mais la réalisation de toutes les analyses univariées et multivariées peut prendre du temps.

- Temps perdu à coder et à déboguer. Soyons honnêtes : personne ne peut se souvenir de tous les paramètres des modèles numpy, pandas et sklearn. Nous devons constamment rechercher de la documentation lors du codage.

- Les données riches et non structurées ne sont pas pleinement utilisées.. Les entreprises génèrent chaque jour une grande quantité de données textuelles à partir d’enquêtes, de tickets d’assistance et d’avis. Mais extraire des informations de manière évolutive reste un défi.

Cas idéal : les scientifiques des données se concentrent sur la réflexion approfondie, et non sur la syntaxe.

- L'écriture de code semble plus rapide sans avoir à rechercher la syntaxe.

- Les analystes passent plus de temps à interpréter les résultats et moins de temps à travailler avec les données.

- Les données non structurées ne constituent plus un obstacle et peuvent être analysées rapidement.

Lorsque vous voyez le cas idéal, je suis sûr que vous avez déjà quelques outils d’IA en tête. Voyons comment l’IA peut réellement avoir un impact ou faire une différence :

- Assistants IA pour le codage et le débogage. Je pense que c’est de loin le type d’outil d’IA le plus fiable pour quiconque code. Nous voyons déjà cela se reproduire.

- Quand les chatbots LLM aiment ChatGPT et ClaudeLes ingénieurs ont réalisé qu’ils pouvaient simplement poser leurs questions de syntaxe ou leurs messages d’erreur à un chatbot qui obtiendrait des réponses très précises. Cela perturbe toujours votre flux de travail de codage, mais c'est bien mieux que de cliquer sur des dizaines d'onglets StackOverflow - et cela ressemble déjà au siècle dernier.

- Plus tard, nous voyons émerger des outils de codage d'IA intégrés de plus en plus nombreux. Copilote GitHub et Curseur Avec votre éditeur de code, ils peuvent lire votre base de code pour suggérer de manière proactive la complétion du code et déboguer les problèmes au sein de votre IDE.

- Comme je l’ai brièvement mentionné au début, les outils de données comme Flocon et Hex Il comprend également des assistants de codage IA pour aider les analystes de données et les scientifiques des données à écrire du code facilement.

- Intelligence artificielle pour l'analyse et l'analyse exploratoires des données. Il s’agit d’un outil assez similaire aux outils d’assistance BI basés sur le chat que j’ai mentionnés ci-dessus, mais son objectif est plus ambitieux : il commence avec des ensembles de données brutes et vise à automatiser l’ensemble du cycle d’analyse du nettoyage des données, du prétraitement, de l’analyse exploratoire et parfois même de la modélisation. Ce sont les outils qui sont souvent présentés comme « remplaçant les analystes de données » (mais le sont-ils vraiment ?).

- Agent Google Data Science C'est un nouvel outil très impressionnant qui peut créer un Jupyter Notebook entier avec une simple invite. J'ai écrit récemment un article Explique ce qu'il peut et ne peut pas faire. En bref, il peut créer rapidement un Jupyter Notebook bien organisé qui s'exécute sur la base d'un plan d'exécution personnalisable. Cependant, il ne dispose pas des capacités nécessaires pour modifier un Jupyter Notebook en fonction des questions de suivi, nécessite toujours une personne possédant de solides connaissances en science des données pour examiner les méthodes et effectuer des itérations manuelles, et nécessite un énoncé clair du problème de données avec des ensembles de données propres et bien documentés. Je vois donc cela comme un excellent outil pour gagner du temps dans le code initial, plutôt que de menacer nos emplois.

- On peut également le classer comme Outil d'analyse de données ChatGPT Dans ce cadre. Permet aux utilisateurs de télécharger un ensemble de données et de discuter avec lui pour terminer leur analyse, créer des visualisations et répondre à des questions. Vous pouvez retrouver mon article précédent discutant de ses capacités. ici. Il est également confronté à des défis similaires et fonctionne mieux comme assistant EDA plutôt que comme remplaçant des analystes de données.

- Les fonctionnalités du PNL sont faciles à utiliser et évolutives.. Le LLM est excellent dans les conversations. Par conséquent, la PNL est devenue beaucoup plus facile avec le LLM d'aujourd'hui.

- Mon entreprise organise chaque année un hackathon interne. Je me souviens que mon projet de hackathon il y a trois ans consistait à essayer BERT et d'autres méthodes traditionnelles de modélisation de sujets pour analyser les réponses aux enquêtes NPS, ce qui était amusant mais honnêtement très difficile à rendre précis et significatif pour l'entreprise. Puis il y a deux ans, lors d'un hackathon, nous avons essayé API OpenAI Pour classer et synthétiser les données de feedback, le système a parfaitement fonctionné : modélisation thématique haute fidélité, analyse des sentiments et classification des feedbacks, le tout en un seul appel d'API. Le résultat s'est parfaitement adapté à notre contexte métier, grâce aux invites système. Nous avons ensuite créé un pipeline interne facilement extensible pour inclure des données textuelles issues de réponses aux enquêtes, de tickets d'assistance, d'appels commerciaux, de notes d'études utilisateurs, etc. Il est devenu la plateforme centrale pour les feedbacks clients et a guidé notre feuille de route produit. Retrouvez Plus sur Ce blog technique.

- De nombreuses nouvelles entreprises développent également des outils d’analyse des commentaires des clients, des outils d’analyse des avis sur les produits, des outils d’assistance au service client, etc., basés sur l’IA. Les idées sont toutes les mêmes : tirer parti de la manière dont LLM peut comprendre le contexte du texte et mener des conversations pour créer des agents d’IA spécialisés dans l’analyse de texte.

CONCLUSION

Il est facile de se laisser emporter par les derniers outils d’intelligence artificielle (IA). Mais en fin de compte, ce qui compte le plus, c’est d’utiliser l’IA pour éliminer ce qui nous ralentit et accélérer ce qui nous fait avancer. La clé est de rester pragmatique : adopter ce qui fonctionne aujourd’hui, rester curieux de ce qui émerge et ne jamais perdre de vue l’objectif principal de la science des données, qui est de prendre de meilleures décisions grâce à une meilleure compréhension.

Les commentaires sont fermés.