Les erreurs de l'IA de Google : expressions hallucinantes et dictons populaires

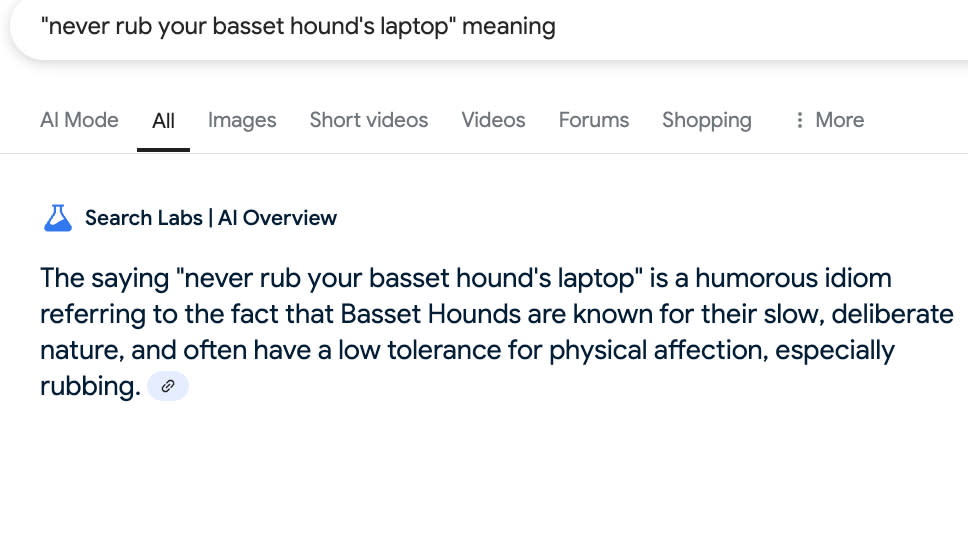

La dernière tendance en matière d’IA est hilarante. Un utilisateur a découvert qu'il était possible de saisir une fausse phrase dans la recherche Google et d'y ajouter le mot « signification ». Ensuite, la fonctionnalité « Aperçu de l'IA » de Google générera une signification pour cette phrase en fonction de votre imagination.

L'historien Greg Jenner a déclenché cette vague avec un article sur Bluesky Il a demandé à Google d’expliquer la signification de l’expression « On ne peut pas lécher un blaireau deux fois ». La fonctionnalité Aperçu de l'IA explique utilement que cette expression signifie que vous ne pouvez pas tromper quelqu'un une deuxième fois après qu'il ait déjà été trompé une fois, ce qui semble être une explication raisonnable, mais ignore le fait que le terme n'existait pas avant que cette requête ne se généralise.

Depuis lors, les gens se sont beaucoup amusés à faire en sorte que la fonctionnalité Aperçu de l'IA explique des termes tels que « un calmar dans un vase ne dira pas de mal de vous » (Sens Quelque chose en dehors de son environnement naturel ne pourrait apparemment pas lui faire de mal) ou « Vous pouvez emmener votre chien à la plage, mais vous ne pouvez pas le faire naviguer jusqu'en Suisse » (C'est, selon la fonctionnalité « AI Overview », est une déclaration assez simple sur la difficulté des voyages internationaux avec des animaux de compagnie.

Depuis lors, les gens se sont beaucoup amusés à faire en sorte que la fonctionnalité Aperçu de l'IA explique des termes tels que « un calmar dans un vase ne dira pas de mal de vous » (Sens Quelque chose en dehors de son environnement naturel ne pourrait apparemment pas lui faire de mal) ou « Vous pouvez emmener votre chien à la plage, mais vous ne pouvez pas le faire naviguer jusqu'en Suisse » (C'est, selon la fonctionnalité « AI Overview », est une déclaration assez simple sur la difficulté des voyages internationaux avec des animaux de compagnie.

Cependant, cela ne fonctionne pas dans tous les cas, car certaines phrases ne renvoient pas de résultats d'aperçu de l'IA. Le scientifique cognitif Gary Marcus a déclaré Câble« C'est très incohérent, ce à quoi on peut s'attendre de la part de GenAI. »

Jenner souligne que même si cela est divertissant, cela met en évidence certains risques potentiels liés au fait de s’appuyer trop fortement sur des sources générées par l’IA comme « AI Overview » pour obtenir des informations. كتب Jenner : « C’est un signe avant-coureur que l’une des fonctions principales de Google – la capacité de vérifier les faits d’une citation, de vérifier une source ou de retrouver quelque chose dont on se souvient imparfaitement – deviendra beaucoup plus difficile si l’IA préfère légitimer les probabilités statistiques plutôt que la vérité réelle. »

Ce n’est pas la première fois que l’on souligne les limites des informations fournies par l’IA, en particulier la fonction Aperçu de l’IA. Lorsque l’article « AI Overview » a été publié, il suggérait de manière tristement célèbre que les gens devraient manger une petite pierre par jour et qu’ils pouvaient mettre de la colle sur leur pizza, bien que ces réponses spécifiques aient été rapidement supprimées.

Depuis lors, Google a déclaré que la plupart des aperçus de l'IA fournissent des informations utiles et factuelles, et qu'il continue de recueillir des commentaires sur son produit d'IA.

Pour l’instant, laissez ceci vous rappeler de vérifier les informations qui apparaissent dans la case « Aperçu de l’IA » en haut des résultats Google, car elles peuvent ne pas être exactes.

Les commentaires sont fermés.