Les secrets du téléphone dont les passionnés d'IA ont besoin : exploiter au maximum Gemini et ChatGPT

L’une des tendances les plus remarquables – et franchement, les plus ennuyeuses – dans l’industrie des smartphones au cours des deux dernières années a été le discours constant sur les expériences d’IA. Les entreprises de silicium, en particulier, se vantent souvent de la manière dont leurs derniers processeurs mobiles permettront des opérations d'IA sur l'appareil, comme la création de vidéos.

Nous y sommes déjà, mais pas complètement. Au milieu de tout le battage médiatique autour des astuces d’IA qui réussissent ou non aux utilisateurs de smartphones, la discussion va rarement au-delà des vitrines tape-à-l’œil de nouveaux processeurs et de chatbots en constante évolution.

Ce n’est que lorsque l’absence de Gemini Nano du Google Pixel 8 a fait sourciller que le public a appris l’importance cruciale de la capacité RAM pour l’IA sur les appareils mobiles. Apple a également rapidement précisé qu'il limiterait Apple Intelligence aux appareils dotés d'au moins 8 Go de RAM. Cette décision reflète l’importance de la RAM dans l’exécution efficace des modèles d’IA.

Mais l’image d’un « téléphone IA » ne se résume pas à la capacité de mémoire. La capacité de votre téléphone à exécuter des tâches basées sur l'IA dépend également des optimisations invisibles de la RAM, ainsi que du stockage. Et non, je ne parle pas seulement de capacité.

Les innovations en matière de mémoire arrivent sur les téléphones IA.

Digital Trends s'est entretenu avec Micron, un leader mondial des solutions de mémoire et de stockage, pour analyser le rôle de la RAM et du stockage dans les opérations d'IA sur les smartphones. Les avancées de Micron devraient être sur votre radar la prochaine fois que vous achèterez un téléphone haut de gamme.

Les derniers produits de la société basée dans l'Idaho comprennent le stockage mobile UFS 9 G4.1 NAND et les modules RAM 1γ (1-gamma) LPDDR5X pour les smartphones phares. Alors, comment ces solutions de mémoire font-elles progresser l’IA sur les smartphones, en plus d’augmenter la capacité ?

Commençons par la solution de stockage NAND UFS 9 du G4.1. La principale promesse est une consommation d’énergie économique, une latence réduite et une bande passante élevée.. La norme UFS 4.1 peut atteindre des vitesses de lecture et d'écriture séquentielles de pointe de 4100 Mo/s, soit une augmentation de 15 % par rapport à la génération UFS 4.0, tout en réduisant les chiffres de latence.

Un autre avantage crucial est que les unités de stockage portables de nouvelle génération de Micron sont disponibles dans des capacités allant jusqu'à 2 To. De plus, Micron a pu réduire sa taille, ce qui en fait une solution idéale pour les téléphones pliables et les téléphones minces de nouvelle génération comme Samsung Galaxy Bord S25.

Passant aux avancées en matière de RAM, Micron a développé ce qu'il appelle des modules RAM 1γ LPDDR5X. Il offre une vitesse de pointe de 9200 30 MT/s, peut contenir 20 % de transistors en plus grâce à sa taille réduite et consomme 1 % d'énergie en moins en même temps. Micron a déjà présenté la solution RAM 1β (25-beta) légèrement plus lente que l'on trouve dans la série de smartphones Samsung Galaxy SXNUMX.

L'interaction entre le stockage et l'intelligence artificielle

Ben Rivera, directeur du marketing produit pour l'unité commerciale mobile de Micron, a expliqué que Micron a introduit quatre améliorations clés dans ses dernières solutions de stockage pour garantir des opérations d'IA plus rapides sur les appareils mobiles. Ces améliorations incluent Zoned UFS, Data Defragmentation, Pinned WriteBooster et Intelligent Latency Tracker.

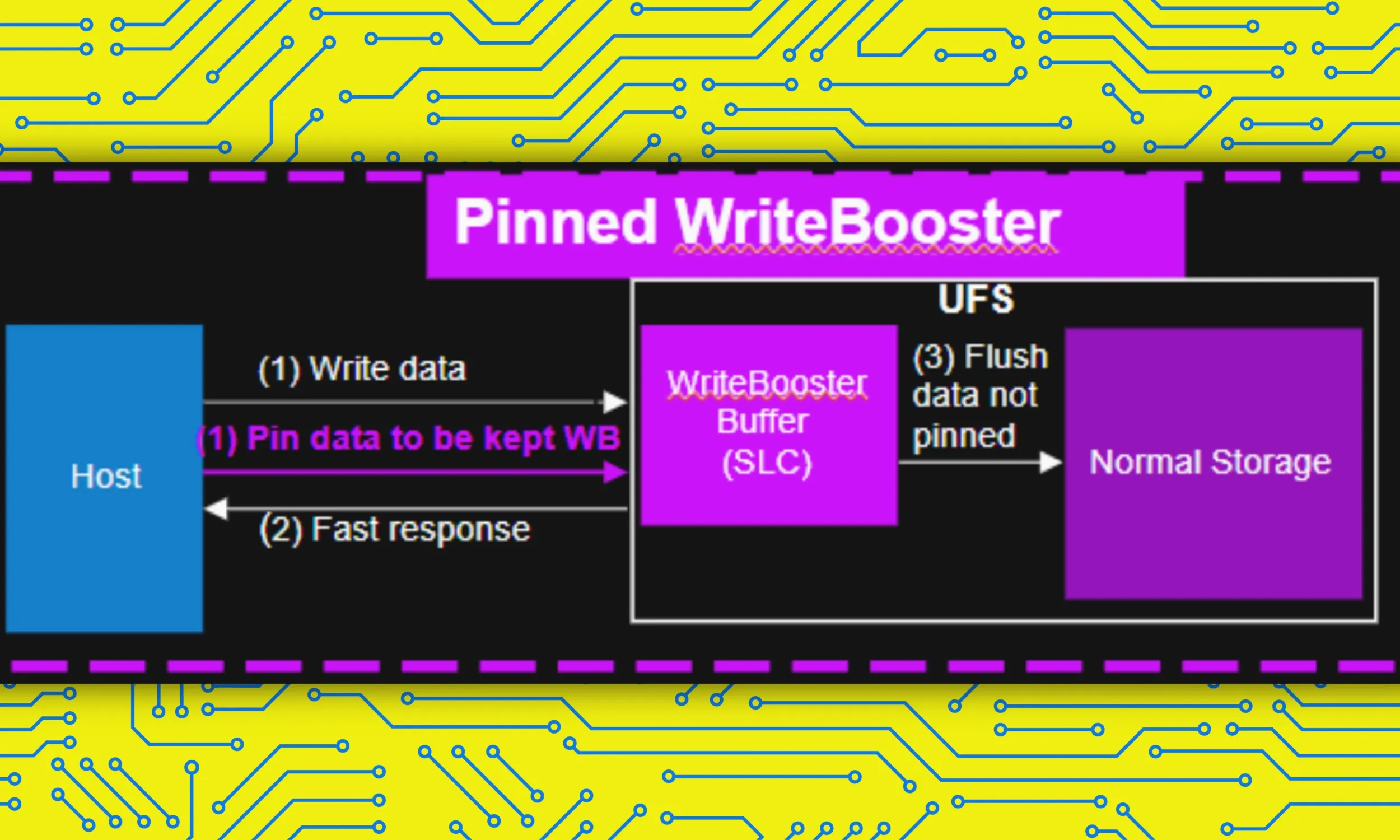

« Cette fonctionnalité permet au processeur ou à l'hôte d'identifier et d'isoler ou « d'épingler » les données les plus fréquemment utilisées dans le smartphone dans une zone du périphérique de stockage appelée tampon WriteBooster (similaire à un cache) pour permettre un accès rapide et immédiat à celles-ci », explique Rivera à propos de la fonctionnalité Pinned WriteBooster.

Chaque modèle d’IA, comme Google Gemini ou ChatGPT, qui cherche à effectuer des tâches sur un appareil a besoin de son propre ensemble de fichiers d’instructions stockés localement sur l’appareil mobile. Par exemple, vous avez besoin Apple Intelligence jusqu'à 7 Go d'espace de stockage Pour toutes ses opérations.

Pour effectuer une tâche, vous ne pouvez pas déléguer l’intégralité de la pile d’IA à la RAM, car elle aura besoin d’espace pour traiter d’autres tâches importantes telles que passer des appels ou interagir avec d’autres applications importantes. Pour répondre aux limitations du stockage Micron, une carte mémoire est créée qui charge uniquement les poids AI requis du stockage vers la RAM.

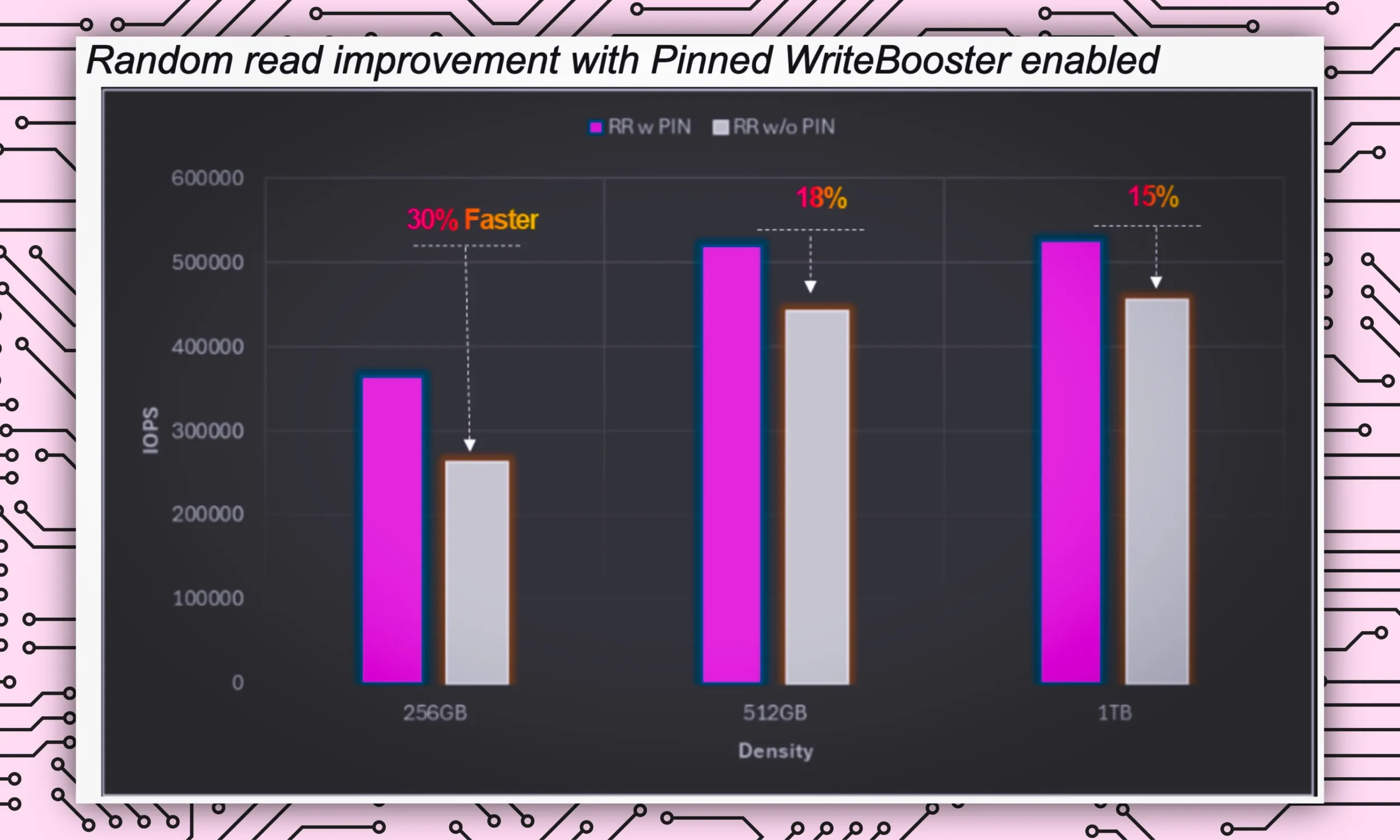

Lorsque les ressources deviennent limitées, vous avez besoin d’un échange et d’une lecture de données plus rapides. Cela garantit que vos tâches d’IA sont exécutées sans affecter la vitesse d’autres tâches importantes. Grâce à Pinned WriteBooster, cet échange de données est accéléré de 30 %, garantissant que les tâches d'IA sont traitées sans aucun délai.

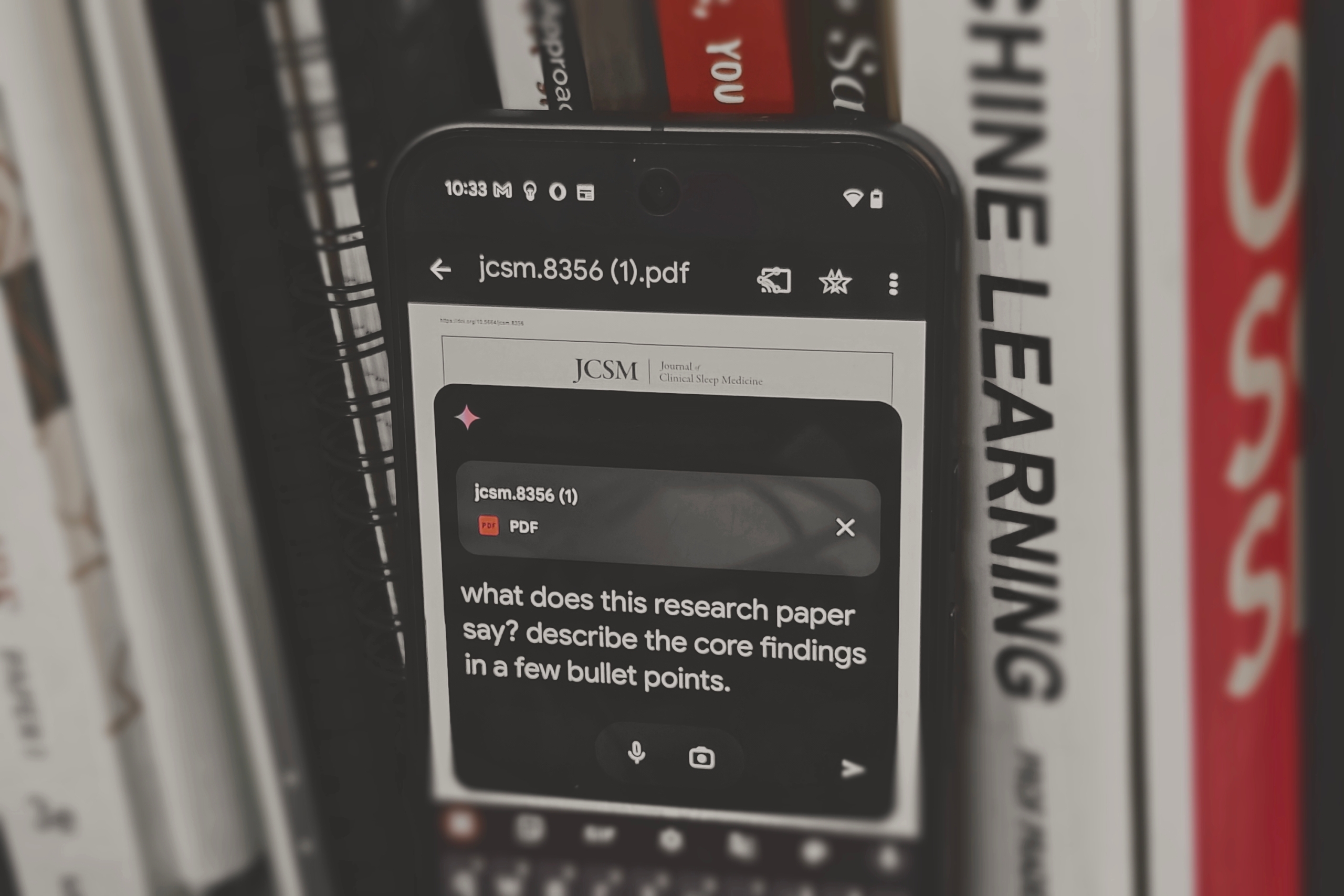

Supposons que vous ayez besoin de Gemini pour extraire le fichier PDF pour analyse. L'échange rapide de mémoire garantit que les poids d'IA requis sont rapidement transférés du stockage vers la RAM.

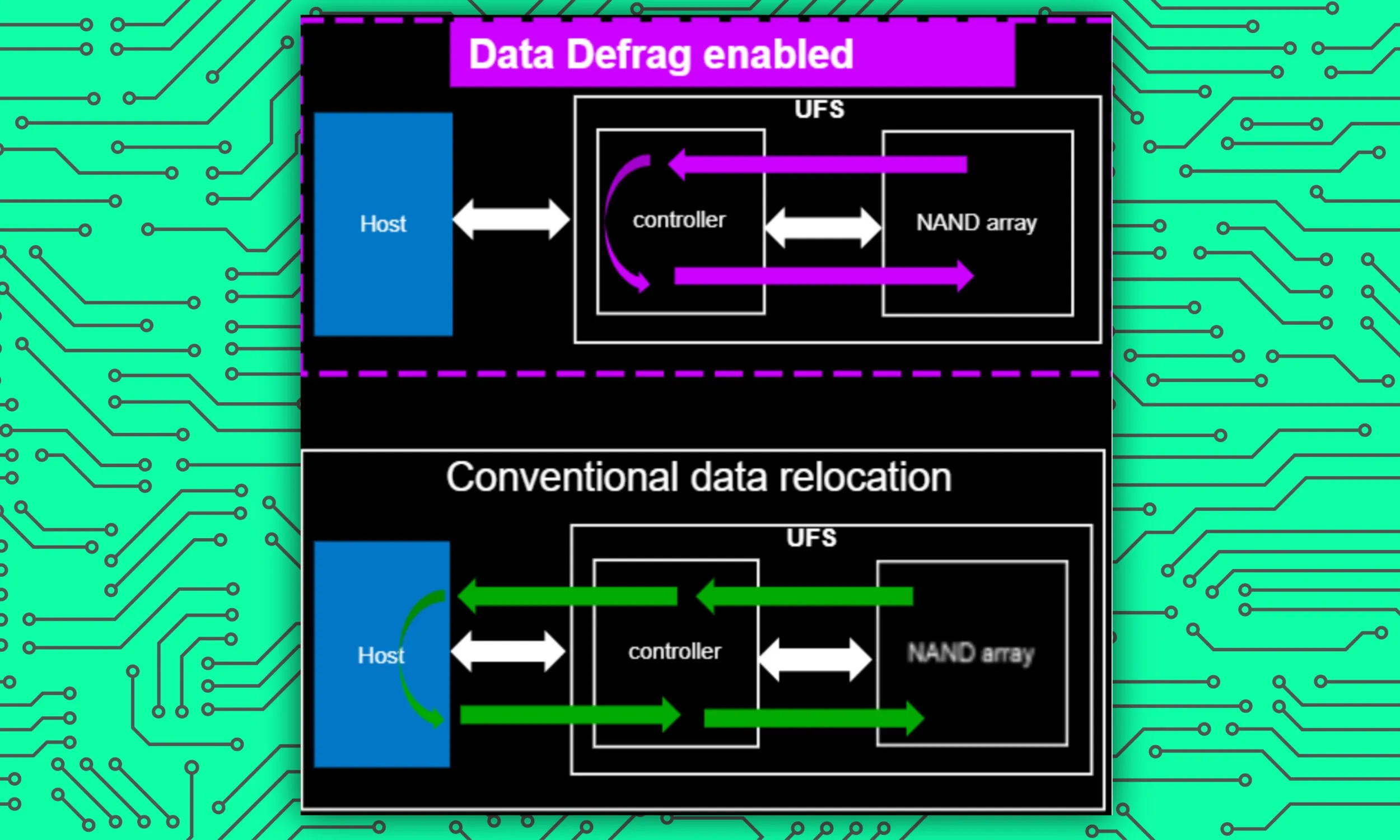

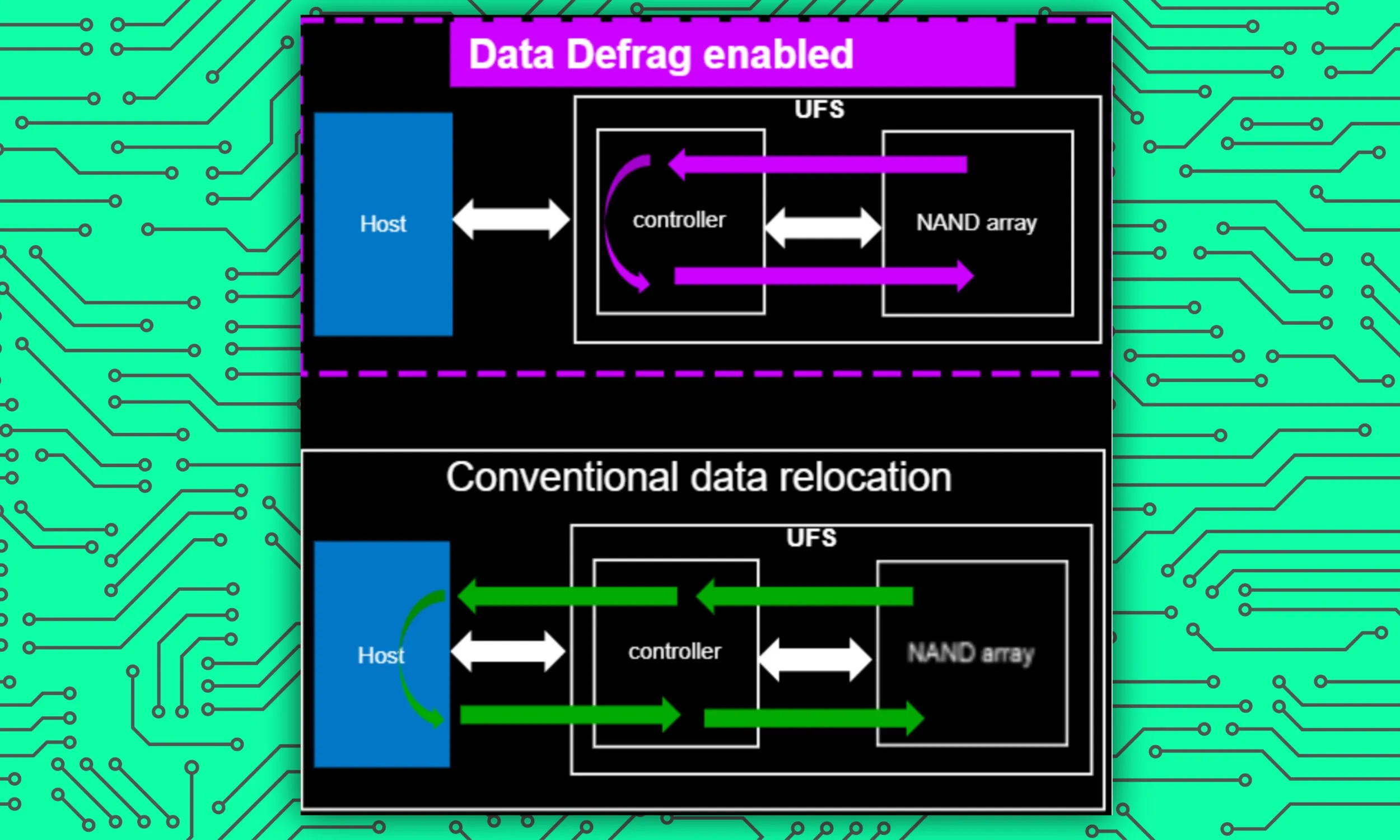

Ensuite, nous avons Data Defrag. Considérez-le comme un organisateur de bureau ou de placard, garantissant que les objets sont soigneusement regroupés dans différentes catégories et placés dans leurs armoires uniques afin qu'ils soient faciles à trouver.

Dans le contexte des smartphones, si une grande quantité de données est stockée sur une longue période d'utilisation, elles le sont généralement de manière quelque peu aléatoire. Par conséquent, lorsque le système embarqué doit accéder à un type de fichier particulier, il devient plus difficile de tous les retrouver, ce qui ralentit le fonctionnement.

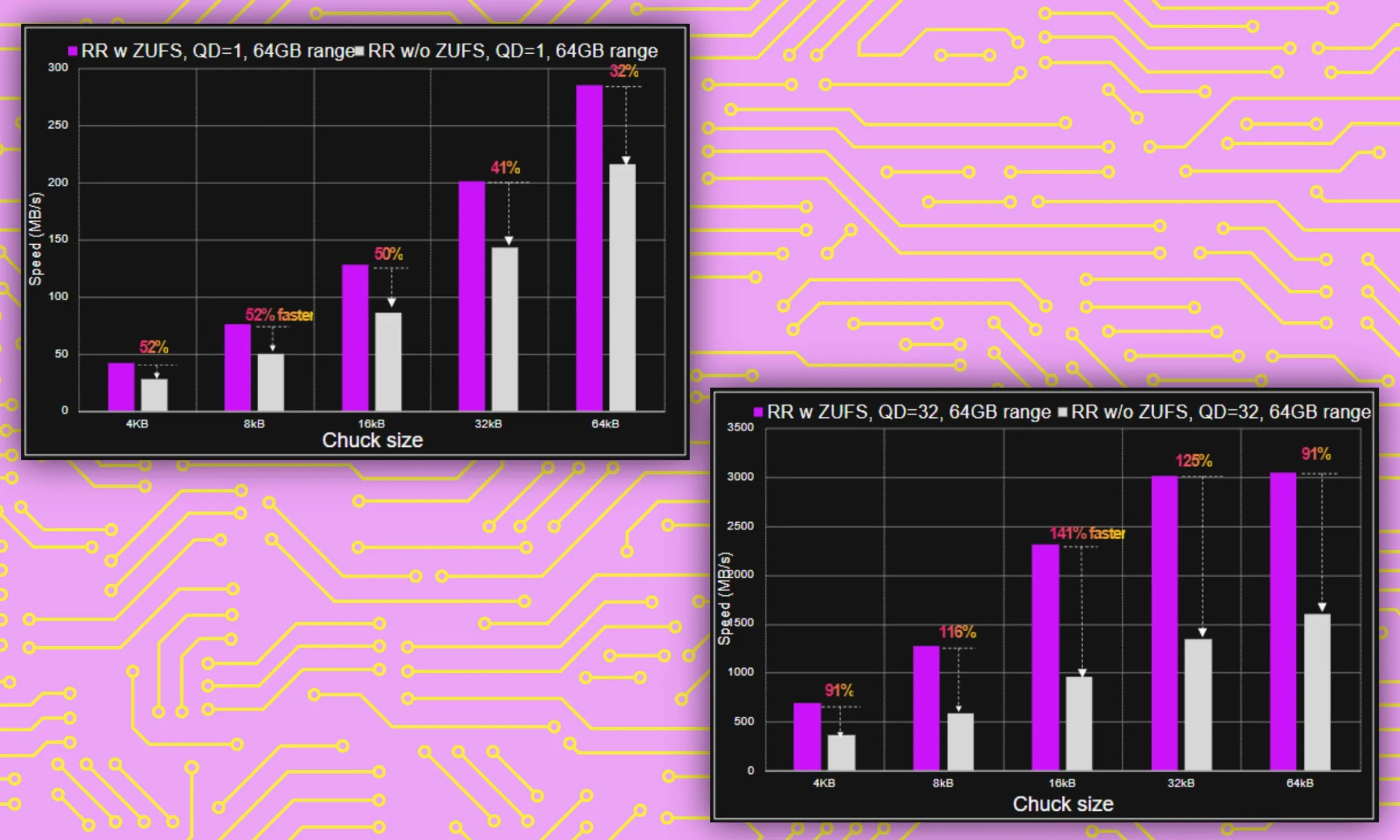

Selon Rivera, Data Defrag aide non seulement à organiser le stockage des données, mais modifie également la façon dont le périphérique de stockage interagit avec le contrôleur de l'appareil. Ainsi, il Augmente la vitesse de lecture des données de 60 %, accélérant naturellement tous les types d’interactions utilisateur-appareil, y compris les tâches d’IA.

« Cette fonctionnalité peut aider à accélérer les fonctionnalités de l'IA, par exemple lorsqu'un modèle d'IA génératif, tel que celui utilisé pour générer une image à partir d'une invite de texte, est appelé du stockage vers la mémoire, permettant aux données d'être lues plus rapidement du stockage vers la mémoire », a déclaré un responsable de Micron à Digital Trends.

Intelligence Latency Tracker est une autre fonctionnalité qui surveille essentiellement les événements de latence et les facteurs susceptibles de ralentir le rythme habituel de votre téléphone. Il aide ensuite à corriger les erreurs et à améliorer les performances du téléphone pour garantir que les tâches normales, ainsi que les tâches d'IA, ne rencontrent pas de ralentissements.

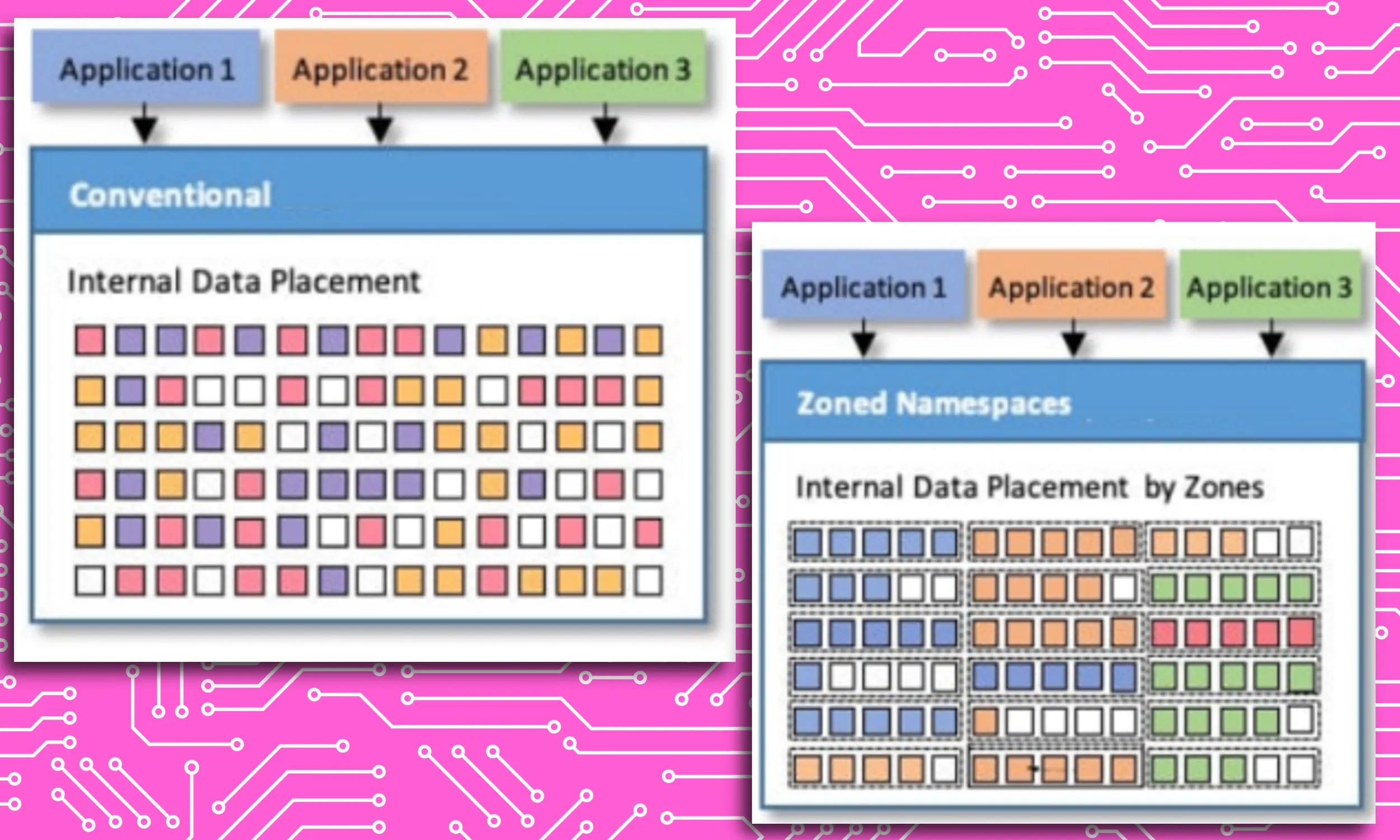

L’amélioration finale du stockage est le Zoned UFS. Ce système garantit que les données de nature d’entrée/sortie similaire sont stockées de manière organisée. Ceci est très important car cela permet au système de localiser plus facilement les fichiers nécessaires, au lieu de perdre du temps à chercher dans tous les dossiers et répertoires.

« La fonctionnalité ZUFS de Micron permet d'organiser les données de sorte que lorsque le système doit localiser des données spécifiques pour une tâche, le processus est plus rapide et plus fluide », nous a expliqué Rivera.

Débordement de RAM

En ce qui concerne les flux de travail d’IA, vous avez besoin d’une certaine quantité de RAM. Plus la capacité est grande, mieux c'est. Alors qu'Apple a fixé la base de référence à 8 Go pour sa suite Apple Intelligence, les acteurs de l'écosystème Android sont passés à 12 Go par défaut. pourquoi ?

« Les expériences d’IA sont également gourmandes en données et en énergie », explique Rivera. « Ainsi, pour tenir la promesse de l’IA, la mémoire et le stockage doivent offrir une faible latence et des performances élevées avec une efficacité énergétique maximale. »

Avec sa solution DRAM LPDDR5X 1γ (1-gamma) de nouvelle génération pour smartphones, Micron a pu réduire la tension de fonctionnement des modules de mémoire. Ensuite, il y a la question cruciale de la performance locale. Rivera affirme que les nouveaux modules de mémoire peuvent fonctionner à des vitesses allant jusqu'à 9.6 gigabits par seconde, garantissant des performances d'IA exceptionnelles.

Micron affirme que les améliorations apportées à son procédé de lithographie ultraviolette extrême (EUV) ont ouvert la porte non seulement à des vitesses plus élevées, mais également à une augmentation de 20 % de l'efficacité énergétique.

La voie vers des expériences d’IA plus personnalisées ?

Les solutions de RAM et de stockage de nouvelle génération de Micron pour smartphones visent non seulement à améliorer les performances de l'IA, mais également à accélérer globalement vos tâches quotidiennes sur smartphone. Je me demandais si le stockage mobile UFS 9 NAND amélioré du G4.1 et la RAM LPDDR1X 1γ (5-gamma) accéléreraient également les processeurs d'IA hors ligne.

Les fabricants de smartphones ainsi que les laboratoires d’IA se tournent de plus en plus vers le traitement local de l’IA. Cela signifie qu'au lieu d'envoyer vos requêtes à un serveur cloud où le processus est traité, puis le résultat est envoyé sur votre téléphone via une connexion Internet, l'ensemble du flux de travail est exécuté localement sur votre téléphone.

De la transcription des appels et des notes vocales au traitement de documents de recherche complexes au format PDF, tout se passe sur votre téléphone et aucune donnée personnelle ne quitte jamais votre appareil. C'est également une approche plus sûre et plus rapide, mais elle nécessite en même temps des ressources système puissantes. Un module de mémoire plus rapide et plus efficace est l’une de ces exigences essentielles.

Les solutions de nouvelle génération de Micron peuvent-elles aider à répondre à l’IA au niveau local ? Elle peut. En fait, cela accélérera également les processus qui nécessitent une connexion au cloud, comme la création de vidéos à l'aide du modèle Veo de Google, qui nécessite toujours des serveurs informatiques puissants.

« Une application d'IA native exécutée directement sur l'appareil aura le plus de trafic car elle lit non seulement les données utilisateur à partir du périphérique de stockage, mais effectue également des inférences d'IA sur l'appareil », explique Rivera. « Dans ce cas, nos fonctionnalités contribueront à optimiser le flux de données pour les deux parties. »

Alors, quand pouvez-vous vous attendre à ce que les téléphones équipés des dernières solutions de Micron arrivent dans les rayons ? Rivera affirme que tous les principaux fabricants de smartphones adopteront les modules de RAM et de stockage de nouvelle génération de Micron. En termes d’accès au marché, « les principaux modèles lancés fin 2025 ou début 2026 » devraient figurer sur votre radar d’achat.

Les commentaires sont fermés.