Modèles d'IA : des capacités énormes, mais insuffisantes dans l'industrie du jeu vidéo

À mesure que les outils d'IA évoluent, nous sommes constamment encouragés à leur déléguer des tâches complexes. Les grands modèles linguistiques peuventLLM) Rédiger nos e-mails, créer des présentations, concevoir des applications, créer des vidéos, rechercher sur Internet et résumer les résultats, et bien plus encore. Cependant, il y a une chose avec laquelle j’ai encore beaucoup de mal, ce sont les jeux vidéo.

Jusqu’à présent cette année, deux des plus grandes entreprises d’IA (Microsoft et Anthropic) ont essayé de faire en sorte que leurs modèles créent ou jouent à des jeux, et les résultats sont probablement beaucoup plus limités que ce que beaucoup de gens attendent. Cela met en évidence les défis actuels de l’IA générative, en particulier dans les tâches qui nécessitent une planification stratégique à long terme et une prise de décision complexe.

Cela en fait des démonstrations parfaites de ce que l’IA générative est réellement en train de faire aujourd’hui – en bref : elle peut faire beaucoup plus qu’avant, mais elle ne peut pas tout faire. Cela montre que l’IA générative est encore en phase de développement et que, malgré ses capacités croissantes, elle est toujours confrontée à des limites dans certains domaines.

Microsoft produit Quake II avec intelligence artificielle

La production de jeux vidéo est confrontée à des défis similaires à ceux rencontrés dans la production vidéo, où le mouvement est étrange et déformé, et l’IA commence à perdre contact avec la « réalité » après un certain temps. La dernière tentative de Microsoft, qui Tout le monde peut l'essayer.Il s'agit d'une version générée par l'IA de Quake II.

J'ai joué au jeu plusieurs fois et c'est une expérience vraiment étrange, avec des ennemis désorientants apparaissant de nulle part et l'environnement autour de vous changeant au fur et à mesure que vous vous déplacez. Souvent, lorsque j'entrais dans une nouvelle pièce, la porte disparaissait lorsque je me tournais vers elle, et lorsque je regardais à nouveau devant moi, les murs avaient bougé.

L'expérience ne dure que quelques minutes avant de s'arrêter et de vous inviter à démarrer une nouvelle partie, mais si vous n'avez pas de chance, elle peut cesser de répondre correctement à vos entrées avant même cela.

Cependant, c’est une expérience formidable et je pense qu’il serait bénéfique que davantage de personnes la voient. Cela vous permet de découvrir par vous-même les points forts de l’IA générative et ses limites actuelles. Même s'il est impressionnant que nous ayons réussi à créer une expérience de jeu vidéo interactive, il est difficile d'imaginer que quiconque puisse jouer à cette démo technologique et croire que le prochain Assassin's Creed sera produit par l'IA.

Cependant, ce genre d’idées et d’hypothèses existe, en grande partie parce que les gens ne peuvent pas échapper à l’écoute de l’IA en ce moment. Même si l’IA ne vous intéresse pas du tout, elle vous sera imposée partout où vous irez. Le problème est que les informations que reçoit la personne moyenne sont presque entièrement constituées de commentaires marketing de grandes entreprises technologiques et de commentaires de dirigeants repris par les publications d’actualité.

Cela signifie qu'ils entendent des affirmations exagérées et contradictoires comme celles-ci :

Il a le potentiel de résoudre certains des plus grands problèmes du monde, tels que le changement climatique, la pauvreté et les maladies. (ل غيتس)

Il est probable qu'en 2025, chez Meta, ainsi que d'autres entreprises qui travaillent principalement sur ce sujet, nous disposerons d'une IA capable d'agir comme ingénieur de niveau intermédiaire dans votre entreprise et d'écrire du code efficacement. (Mark Zuckerberg)

L’utilisation efficace de l’IA est désormais une attente fondamentale pour tout le monde chez Shopify. C’est un outil pour toutes les professions aujourd’hui, et il ne fera que gagner en importance au fil du temps. Franchement, je ne pense pas qu’il soit possible d’éviter d’apprendre la compétence d’appliquer l’IA dans votre entreprise. (Toby Lutke, PDG de Shopify)

Nous sommes désormais convaincus de savoir comment construire l’intelligence artificielle générale (IAG) telle que nous l’avons traditionnellement comprise. Nous pensons qu’en 2025, nous pourrions voir les premiers agents IA « rejoindre le marché du travail » et changer fondamentalement la façon dont les entreprises produisent. (Sam Altman, PDG d'OpenAI)

L’intelligence artificielle est plus dangereuse que, par exemple, une conception d’avion mal gérée, un mauvais entretien de la production ou une production automobile de mauvaise qualité, dans le sens où elle a le potentiel – aussi petit soit-il, mais pas négligeable – de détruire la civilisation. (Elon Musk)

Tout cela semble un peu exagéré, n'est-ce pas ? Il est censé nous sauver et nous détruire en même temps, être à la fois un outil pour les professionnels et un outil qui les remplacera - et il semble que nous pourrions obtenir une AGI de niveau science-fiction dès cette année. Lorsque les gens entendent tout cela, ils commencent à s’attendre à des choses incroyables de la part de ces gadgets et croient que tous les employés de bureau passent leurs journées à parler à leur ordinateur comme des personnages de Star Trek.

Mais la réalité n’est pas telle. La réalité ressemble à Quake II, tremblante et floue avec des formes ennemies inintelligibles. Les modèles LLM de niveau ChatGPT étaient déjà une avancée passionnante en 2022 et très amusants à utiliser pour tout le monde, mais pour la majorité des utilisations que les grandes entreprises technologiques nous imposent aujourd'hui, l'IA n'est tout simplement pas assez performante. Les niveaux de précision sont très faibles, les capacités de suivi des instructions sont très faibles, les plages de contexte sont très petites et ils sont uniquement formés sur le charabia d'Internet plutôt que sur des connaissances du monde réel.

Mais créer un jeu vidéo est un objectif extrêmement complexe : après tout, il faut des années à des équipes entières d’humains pour réaliser ces choses. Et si on jouait plutôt à des jeux vidéo ?

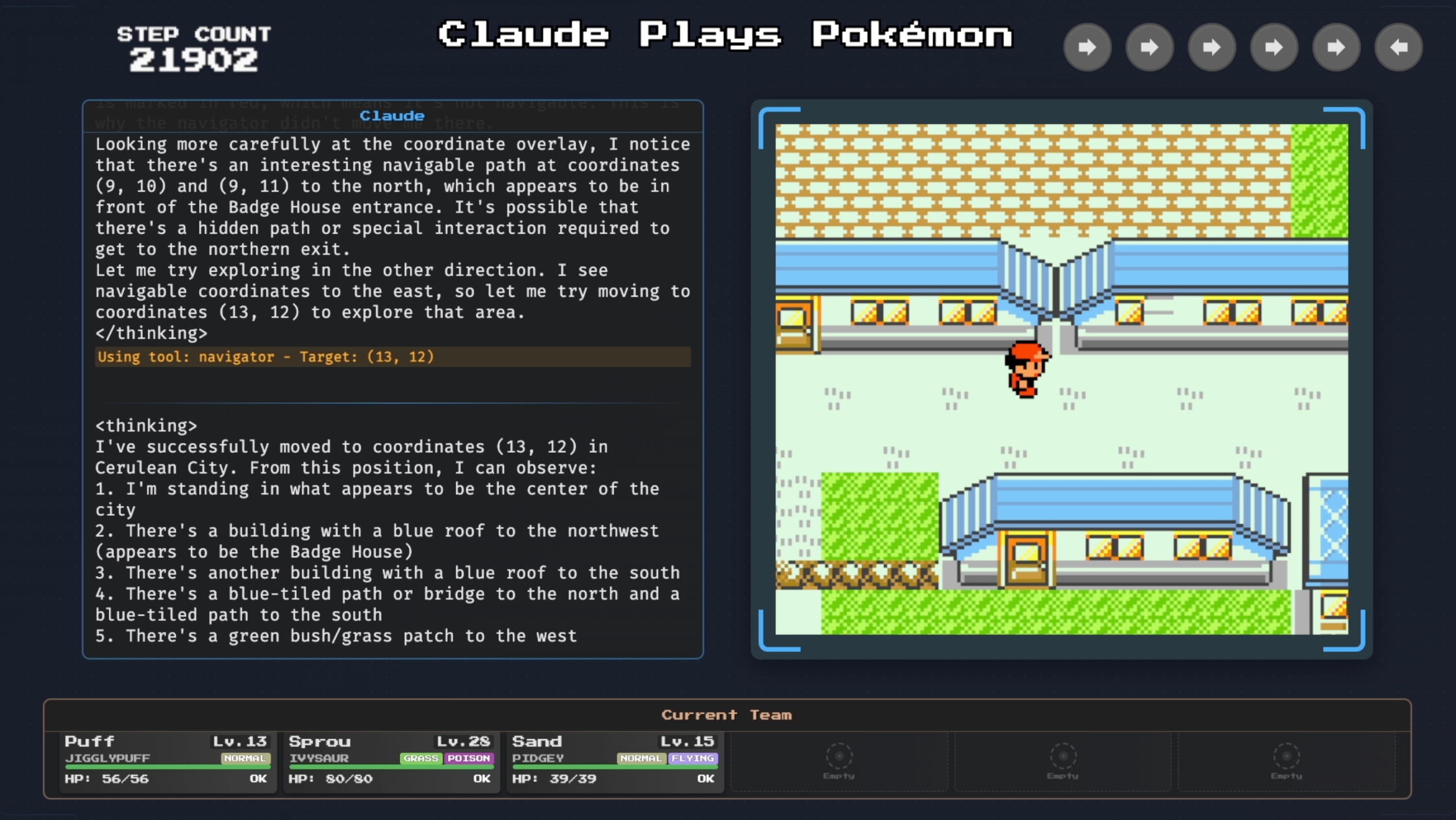

Claude « joue » à Pokémon Rouge

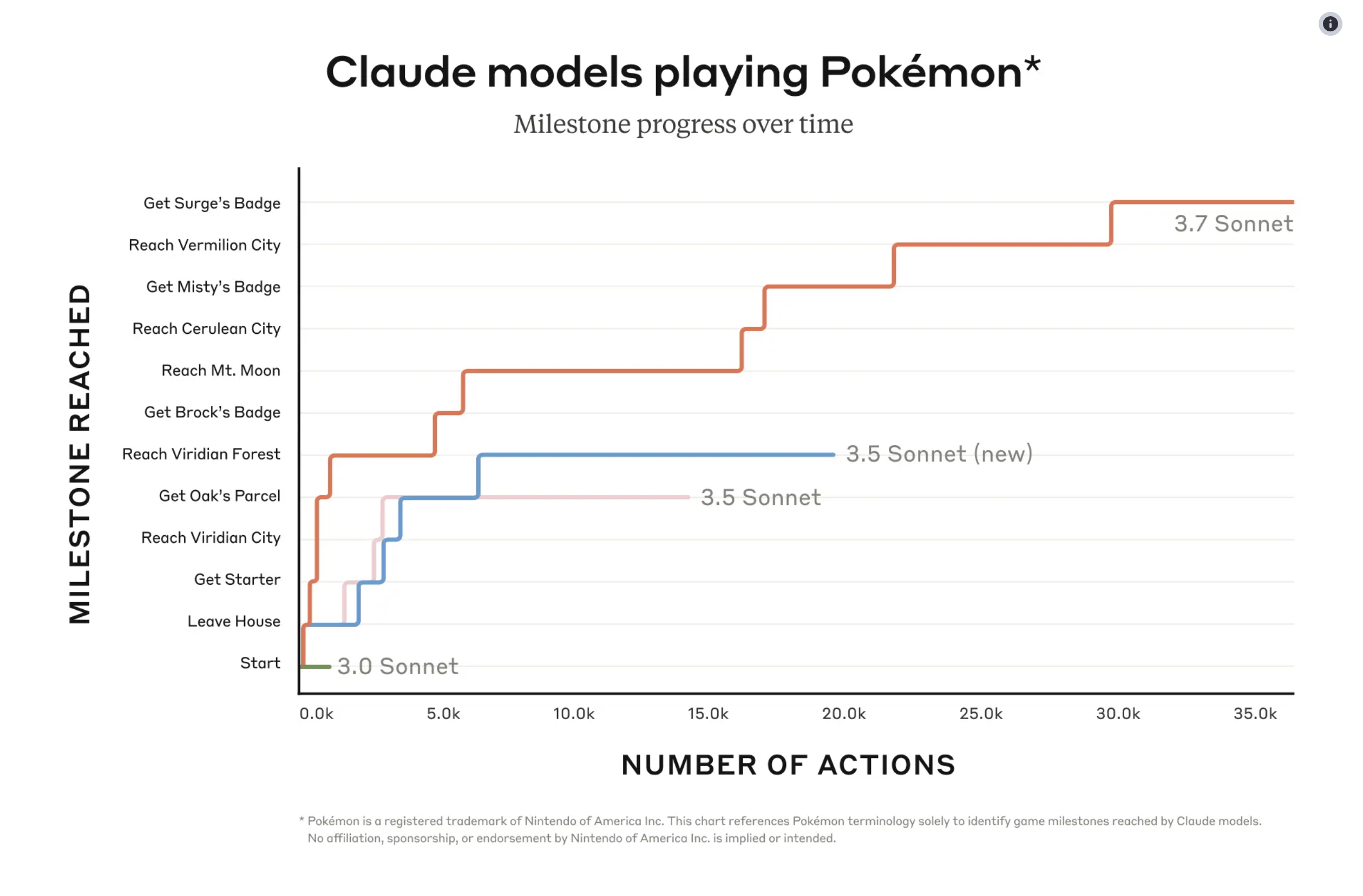

Eh bien, il s’avère que les gens expérimentent également dans ce domaine. Le dernier modèle d'Anthropic, qui est Claude 3.7 Sonnet Il joue Pokémon Rouge sur Twitch Il existe depuis environ deux mois maintenant et il fait le meilleur travail qu'un grand modèle de langage (LLM) ait jamais fait pour jouer à Pokémon. Il y a cependant un petit bémol : il est encore loin du niveau moyen d’un enfant humain de 10 ans.

L’un des problèmes est la vitesse : Claude effectue des milliers d’actions sur plusieurs jours pour faire des choses comme traverser la forêt de Viridian. Cela reflète les défis de l’IA dans la gestion de tâches complexes.

Pourquoi cela prend-il autant de temps ? Ce n’est pas qu’il ne sait pas comment gagner des combats Pokémon de manière stratégique – c’est en fait la partie dans laquelle il est bon. En revanche, naviguer dans l’environnement et éviter les arbres et les bâtiments n’est pas très bon. Claude n'a jamais été entraîné à jouer à Pokémon, et il n'est pas facile pour lui de comprendre le pixel art et ce qu'il représente. Ces difficultés mettent en évidence l’écart entre la capacité à traiter des données et la capacité à interagir avec des environnements complexes.

Traverser des zones labyrinthiques comme le Mont Lune est particulièrement difficile pour lui, car il s'efforce de dresser une carte de la zone et d'éviter d'être retracé. Une fois, il s'est retrouvé tellement coincé dans un coin qu'il a conclu que le jeu était cassé et a émis une demande officielle pour réinitialiser le jeu. Cela illustre comment l’IA, malgré ses capacités avancées, manque encore de la compréhension intuitive que possèdent les humains.

Ces premières tentatives n’étaient pas non plus sans moments amusants.

Un jour, Claude était coincé dans un coin et, convaincu que quelque chose n'allait pas, il a écrit une demande formelle pour réinitialiser le jeu. pic.twitter.com/5RIiCJdxCM— Anthropique (@AnthropicAI) 25 février 2025

Il n’est pas non plus doué pour se souvenir de ses objectifs, des choses qu’il a déjà essayées ou des endroits qu’il a déjà visités.

Il y a une raison très simple à cela : les grands modèles de langage (MLL) ont une « fenêtre contextuelle » limitée qui leur sert de mémoire. Ils ne peuvent contenir qu'une certaine quantité d'informations, et une fois que Claude atteint cette limite, il compresse ce dont il dispose pour faire de la place. Ainsi, une information comme « visité Viridian City, entrée dans chaque bâtiment et conversation avec chaque PNJ » pourrait être compressée en « visité Viridian City », incitant Claude à y retourner et à vérifier s'il y a quelque chose à faire dans la ville.

En bref : Claude ne sait pas où il va, se cogne contre les murs, est dérouté par des objets aléatoires et des PNJ, oublie où il est allé et ce qu'il essaie de faire, et chaque décision qu'il prend nécessite des paragraphes et des paragraphes de réflexion. Il ne s’agit pas d’une critique, mais d’expériences passionnantes qui poussent les grands modèles linguistiques (LLM) aux limites de ce qui est possible.

Mais avec tout le battage médiatique autour de l’IA, il est important que les gens voient des démonstrations comme celle-ci et se forgent leur propre opinion sur l’IA. Certaines personnes essaient de vendre l’idée que nous sommes sur le point d’atteindre un pic d’intelligence – que d’ici quelques années, l’intelligence artificielle (IA) surpassera même les humains les plus intelligents – mais je ne pense pas qu’ils soient honnêtes, ce ne sont que des vendeurs. Nous sommes loin d’avoir atteint le sommet, tout cela ne fait que commencer.

Les commentaires sont fermés.