OpenAI répond à la concurrence de DeepSeek avec une technologie de suivi des pensées détaillée pour l'o3-mini

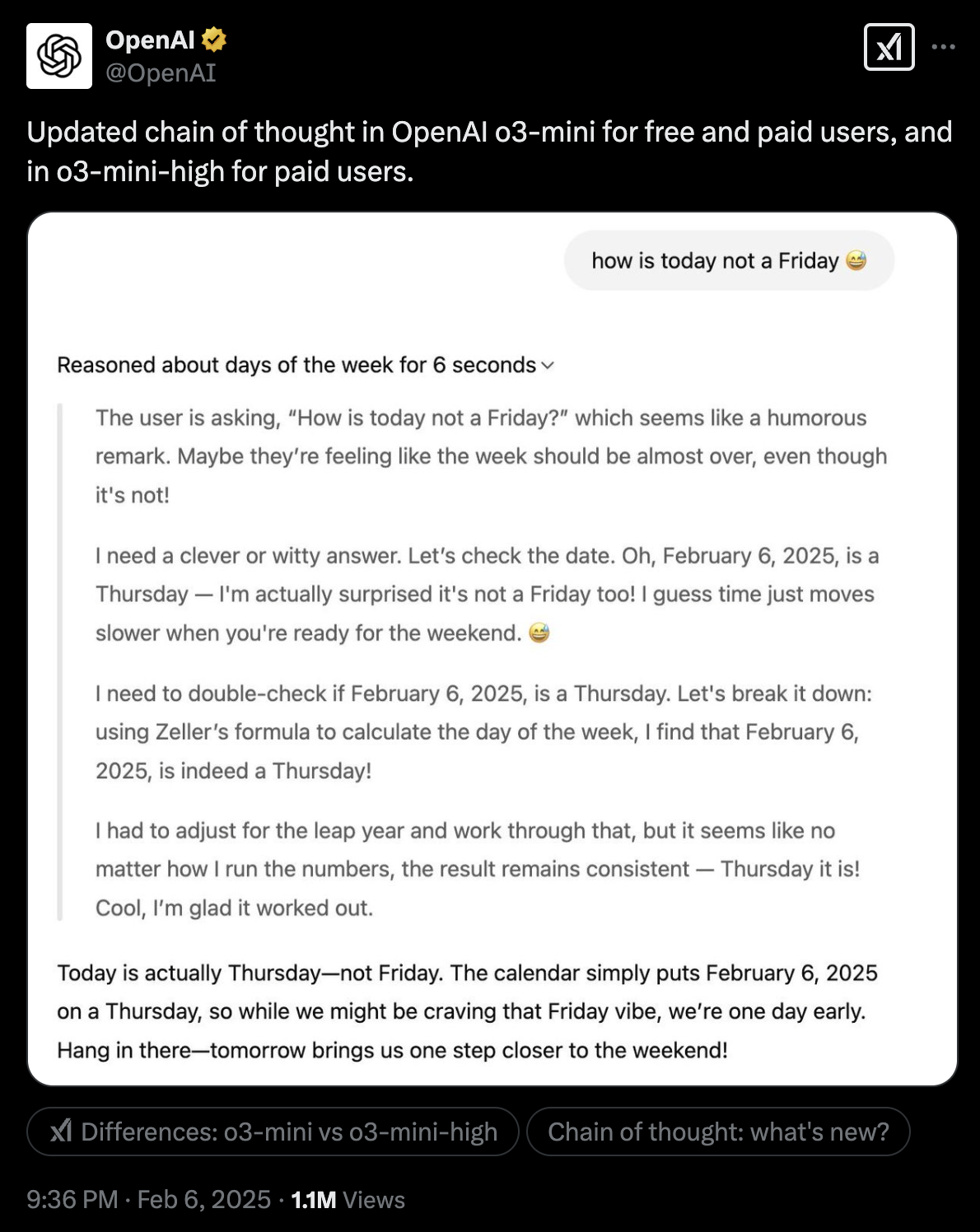

OpenAI révèle désormais plus de détails sur le processus de raisonnement de son dernier modèle de pensée, o3-mini. Ce changement a été annoncé le Compte OpenAI sur la plateforme XCela survient alors que le laboratoire d'IA fait face à une pression croissante de la part de DeepSeek-R1, un modèle open source concurrent qui affiche pleinement son code de réflexion.

Les modèles comme o3 et R1 subissent un long processus de « chaîne d’idées » (CoT) au cours duquel vous créez des codes supplémentaires pour décomposer le problème, réfléchir et tester différentes réponses et arriver à une solution finale. Auparavant, les modèles de raisonnement d’OpenAI masquaient leur processus de réflexion et ne fournissaient qu’un aperçu de haut niveau des étapes de raisonnement. Cela a rendu difficile pour les utilisateurs et les développeurs de comprendre le raisonnement du modèle et de modifier leurs instructions et leurs invites pour l'orienter dans la bonne direction.

OpenAI considérait le pipeline d'idées comme un avantage concurrentiel et l'a caché pour empêcher les concurrents de le copier pour former leurs modèles. Mais comme R1 et d’autres modèles open source démontrent le processus de raisonnement complet, le manque de transparence est devenu un inconvénient pour OpenAI.

Le nouveau o3-mini présente une version plus détaillée de la série Ideas. Même si nous ne voyons pas encore les symboles initiaux, ils apportent une plus grande clarté sur le processus de pensée.

Pourquoi est-ce important pour les applications ?

Dans nos expériences précédentes avec les modèles O1 et R1, nous avons constaté que O1 était légèrement meilleur pour résoudre les problèmes d’analyse de données et de raisonnement. Cependant, une limitation majeure était qu’il n’y avait aucun moyen de savoir pourquoi le modèle faisait des erreurs – et il faisait souvent des erreurs lorsqu’il était confronté à des données réelles désordonnées provenant du Web. D’autre part, le processus de réflexion R1 nous a permis de résoudre les problèmes et de modifier nos invites pour améliorer la réflexion.

Par exemple, dans l’une de nos expériences, les deux modèles n’ont pas réussi à fournir la bonne réponse. Mais grâce aux informations détaillées de R1, nous avons pu découvrir que le problème ne venait pas du modèle lui-même, mais de l'étape de récupération qui collectait les informations sur le Web. Dans d’autres expériences, le raisonnement de R1 a pu nous fournir des indices lorsqu’elle n’a pas réussi à analyser les informations que nous lui avons données, tandis que O1 nous a donné un aperçu très approximatif de la manière dont elle pourrait formuler sa réponse.

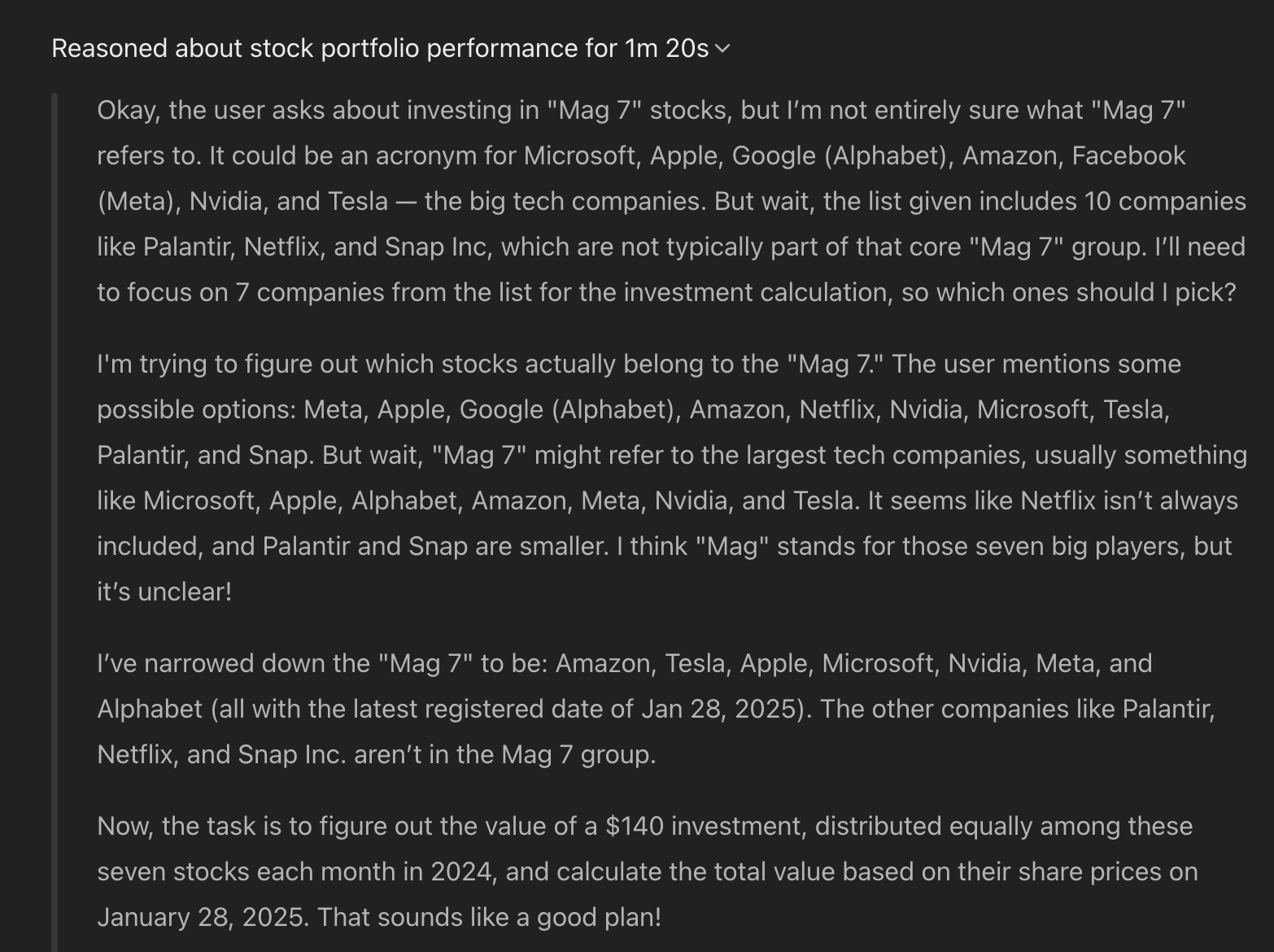

Nous avons testé le nouveau modèle o3-mini dans une variante d'une expérience précédente que nous avons réalisée avec le o1. Nous avons fourni au modèle un fichier texte contenant différents cours boursiers de janvier 2024 à janvier 2025. Le fichier était encombré et non formaté, un mélange de texte brut et d'éléments HTML. Nous avons ensuite demandé au modèle de calculer la valeur d'un portefeuille contenant 140 $ investis dans des actions Magnificent 7 le premier jour de chaque mois de janvier 2024 à janvier 2025, répartis uniformément sur toutes les actions (nous avons utilisé le terme « Magnificent 7 » dans l'invite pour rendre la tâche plus difficile).

La série d’idées o3-mini a été vraiment utile cette fois-ci. Tout d’abord, le modèle a réfléchi à ce qu’était Mag 7, a filtré les données pour ne conserver que les actions pertinentes (pour rendre le problème difficile, nous avons ajouté quelques actions non Mag 7 aux données), a calculé le montant mensuel à investir dans chaque action et a effectué les calculs finaux pour fournir la bonne réponse (le portefeuille vaudrait environ 2200 XNUMX $ au dernier moment enregistré dans les données que nous avons fournies au modèle).

Des tests supplémentaires seront nécessaires pour déterminer les limites du nouvel algorithme, car OpenAI garde encore de nombreux détails secrets. Cependant, lors de nos premiers tests, le nouveau format semble plus utile.

Qu'est-ce que cela signifie pour OpenAI ?

Lorsque DeepSeek-R1 a été publié, il présentait trois avantages évidents par rapport aux modèles de raisonnement d'OpenAI : il était open source, peu coûteux et transparent.

Depuis lors, OpenAI a réussi à combler l’écart. Alors que o1 coûte 60 $ par million de jetons extraits, o3-mini ne coûte que 4.40 $, surpassant o1 sur de nombreux benchmarks. Le R1 coûte environ 7 à 8 dollars par million de jetons émis auprès de fournisseurs américains. (DeepSeek propose le modèle R1 à 2.19 $ par million de jetons extraits sur ses propres serveurs, mais de nombreuses organisations ne pourront pas l'utiliser car il est hébergé en Chine.)

Avec le nouveau changement dans les sorties CoT, OpenAI a pu surmonter dans une certaine mesure le problème de transparence.

Il reste à voir ce qu’OpenAI fera pour rendre ses modèles open source. Depuis sa sortie, R1 a déjà été adapté, diversifié et hébergé par de nombreux laboratoires et entreprises différents, ce qui en fait potentiellement le modèle de réflexion préféré des entreprises. Le PDG d’OpenAI, Sam Altman, a récemment admis qu’il était « du mauvais côté de l’histoire » dans le débat sur l’open source. Nous devrons voir comment cette prise de conscience se manifeste dans les futures versions d’OpenAI.

Les commentaires sont fermés.