Microsoft lance Phi-4 : un modèle d'IA super-inférentiel pour concurrencer DeepSeek R1

Résumé:

- Microsoft a lancé les modèles d'IA inférentiels Phi-4, formés avec 14 milliards et 3.8 milliards de paramètres.

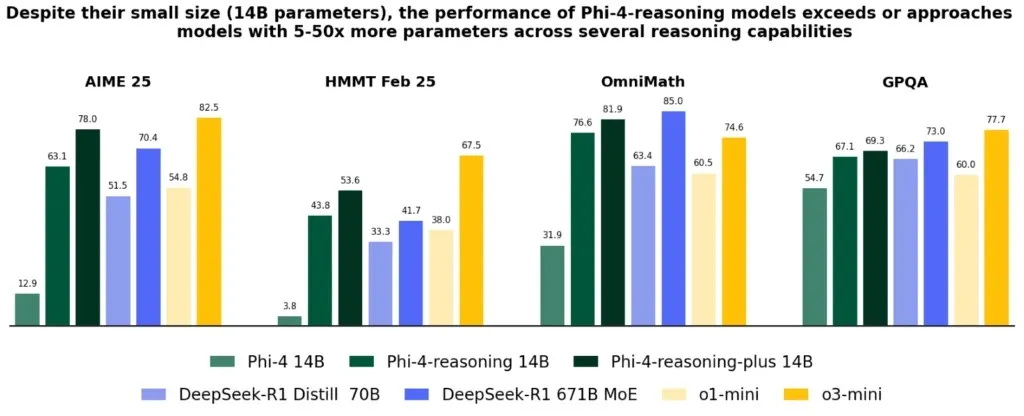

- Malgré sa petite taille, les modèles d'inférence Phi-4 rivalisent avec des modèles beaucoup plus grands comme le DeepSeek R1 et le o3-mini.

- Microsoft affirme que les modèles d'inférence Phi-4 peuvent fonctionner sur des PC exécutant Windows Copilot+, grâce à leur petite taille.

Microsoft a lancé trois nouveaux modèles d'IA déductive, notamment Phi-4-reasoning, Phi-4-reasoning-plus et Phi-4-mini-reasoning. Il s'agit de petits modèles de langage, conçus pour les terminaux tels que les ordinateurs Windows et les appareils mobiles. Le modèle d’IA Phi-4-reasoning est formé avec 14 milliards de paramètres et peut effectuer des tâches d’inférence complexes.

Le modèle Phi-4-raisonnement-plus utilise le même modèle de base, mais utilise un temps d'inférence supplémentaire, environ 1.5 fois plus de jetons que le modèle Phi-4-raisonnement, pour une précision accrue. Malgré leur petite taille, les modèles Phi-4-raisonnement sont compétitifs par rapport à des modèles plus grands tels que DeepSeek R1 671B et o3-mini.

Dans la norme GPQA, le modèle Phi-4-raisonnement-plus-14B obtient un score de 69.3 % tandis que le o3-mini 77.7%. Ensuite, dans le test AIME 2025, le Phi-4-raisonnement-plus-14B obtient 78% et le o3-mini obtient 82.5%. Il montre ensuite que le petit modèle de Microsoft est très proche des principaux modèles d’inférence, qui sont de taille beaucoup plus grande.

Microsoft affirme que les modèles d'inférence Phi-4 ont été formés via un réglage fin supervisé.Sur des démonstrations d'inférence soigneusement organisées à partir d'OpenAI o3-mini. De plus, Microsoft écrit : «Le modèle démontre qu’un formatage précis des données et des ensembles de données synthétiques de haute qualité permettent aux modèles plus petits de concurrencer les modèles plus grands.. »

En dehors de cela, le modèle de raisonnement Phi-4-mini plus petit, formé avec seulement 3.8 milliards de paramètres, surpasse de nombreux modèles 7B et 8B. Sur des benchmarks tels que AIME 24, MATH 500 et GPQA Diamond, le modèle Phi-4-mini-reasoning-3.8B offre des résultats compétitifs, se rapprochant de ceux du o1-mini. C'était terminé"AjusterModèle Phi-4-miniEn utilisant avec précision les données synthétiques générées par le modèle Deepseek-R1. »

Les modèles Phi de Microsoft sont déjà utilisés nativement sur les ordinateurs Windows. PC Copilot+Il bénéficie de l'unité de traitement neuronal intégrée. Il sera intéressant de voir comment les modèles d’inférence Phi-4 améliorent les performances de l’IA sur l’appareil.

Les commentaires sont fermés.