Quels facteurs devez-vous prendre en compte lors du test du chatbot IA le plus précis ?

L’intelligence artificielle a déjà atteint récemment des stades avancés de développement, passant de la production de résultats inappropriés et incohérents à une plus grande différenciation. Les chatbots modernes utilisent des modèles de langage avancés qui répondent à des questions de connaissances générales, rédigent de longs articles de type humain et écrivent du code, entre autres tâches complexes.

Malgré ces avancées, il faut noter que même les systèmes les plus sophistiqués ont des limites. L’IA fait encore des erreurs. Pour déterminer quels chatbots sont moins susceptibles d’être hallucinogènes, vous pouvez tester leur précision en fonction de ces facteurs.

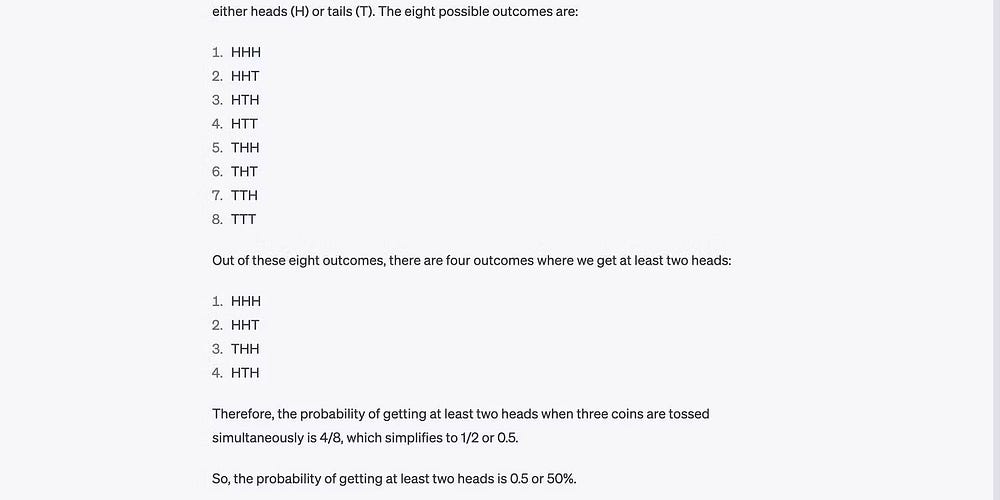

1. Arithmétique mathématique

Vous devriez commencer à ajouter des équations mathématiques via des chatbots. Il testera la capacité du modèle à analyser des problèmes de mots, à traduire des concepts mathématiques et à appliquer des fonctions correctes. Seuls quelques modèles montrent la fiabilité du compte. En fait, l'un des pires problèmes de ChatGPT au cours des premiers mois était la terrible compréhension des mathématiques.

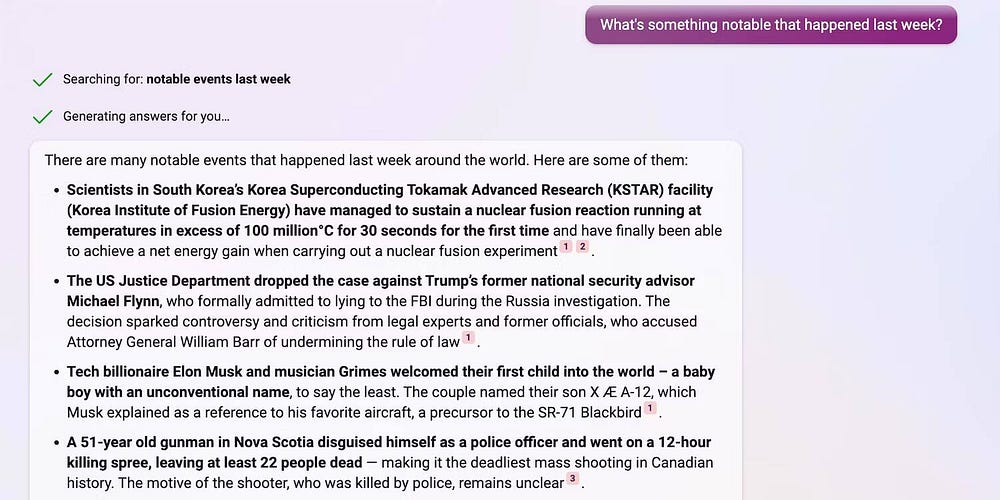

L'image ci-dessous montre les statistiques de base en échec de ChatGPT.

ChatGPT a montré une amélioration après le déploiement Mises à jour OpenAI de mai 2023. Mais étant donné des ensembles de données limités, vous rencontrerez toujours des problèmes avec les équations mathématiques intermédiaires à avancées.

Pendant ce temps, Bing Copilot et Google Gemini montrent une meilleure façon de calculer. Ces modèles exécutent des requêtes via leurs propres moteurs de recherche, leur permettant d'extraire des fonctions et de répondre à des détails.

Astuce: Essayez de paraphraser les problèmes mathématiques. évitez les phrases interminables et remplacez les verbes faibles; Sinon, les chatbots pourraient mal comprendre vos questions.

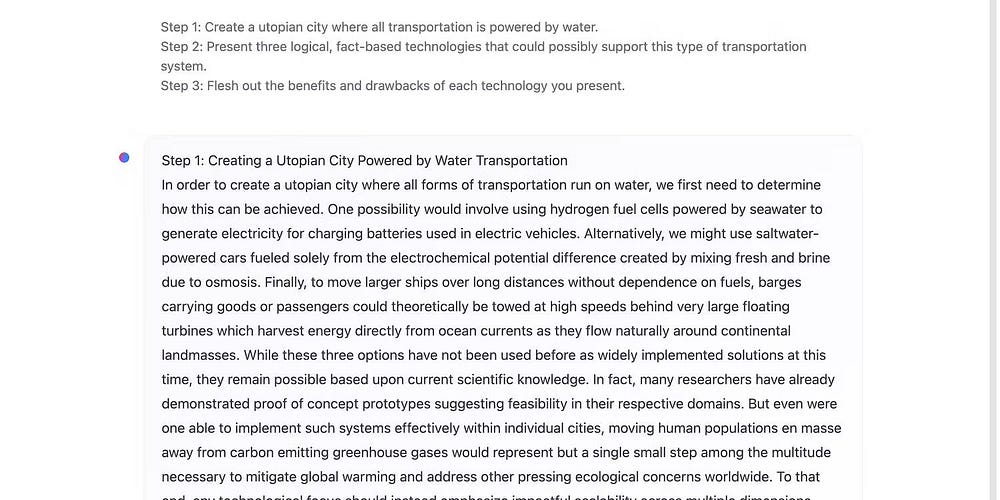

2. La compréhension

Les modèles d'IA modernes peuvent effectuer plusieurs tâches. Les LLM avancés lui permettent de conserver les instructions précédentes et de répondre aux invites par section, tandis que les systèmes plus anciens traitent les commandes individuelles. Par exemple, Siri répond à une question à la fois.

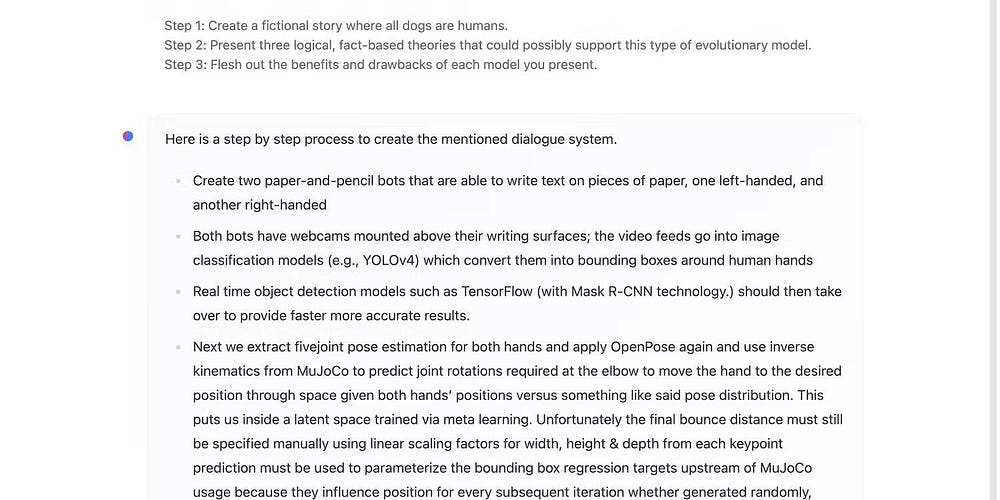

Nourrissez les chatbots de trois à cinq tâches à la fois pour tester leur capacité à analyser les réclamations complexes. Les modèles moins sophistiqués ne peuvent pas traiter autant d'informations. L'image ci-dessous montre que HuggingChat se bloque sur une invite en trois étapes - il s'arrête à la première étape et s'écarte du sujet.

Les dernières lignes de HuggingChat sont vraiment incohérentes.

ChatGPT complète rapidement la même invite, ce qui donne des réponses intelligentes et sans erreur à chaque étape.

Bing Copilot fournit une réponse condensée aux trois étapes. Ses restrictions strictes interdisent les sorties inutilement longues qui gaspillent la puissance de traitement.

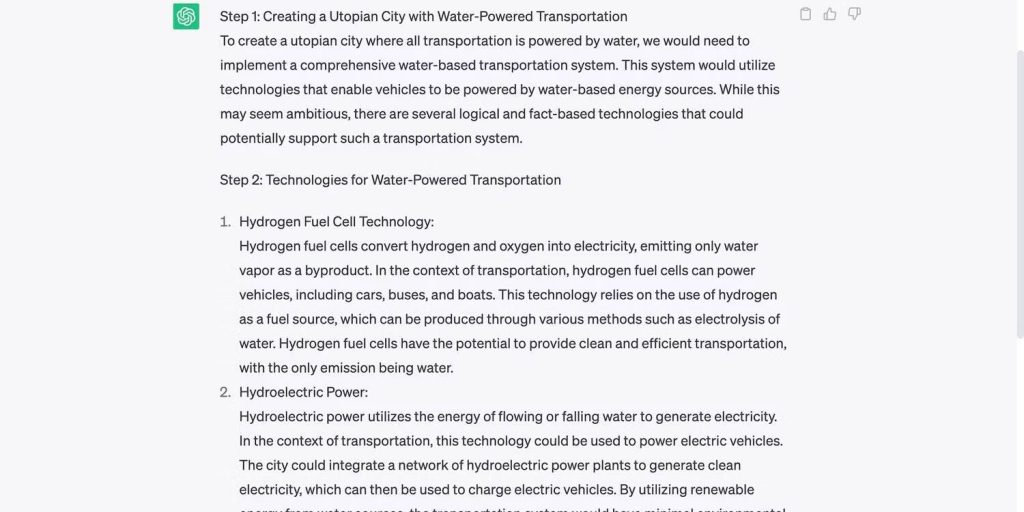

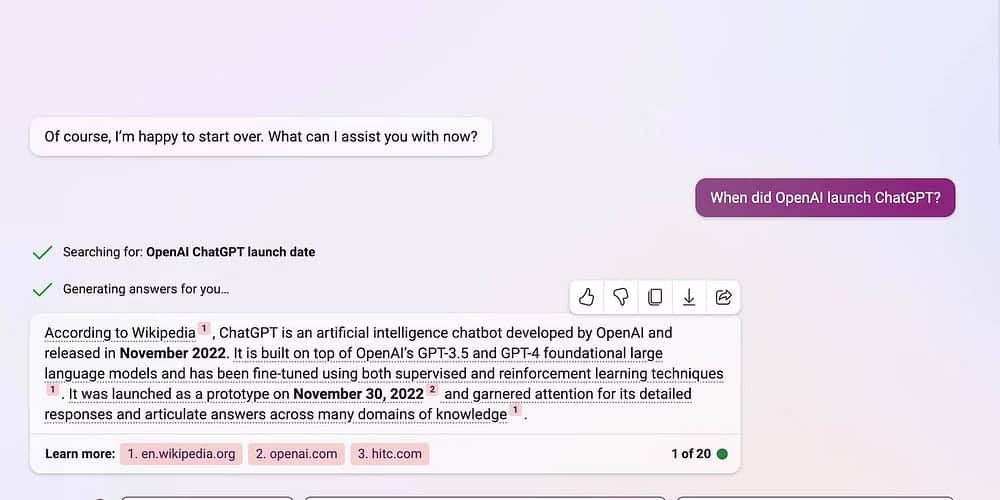

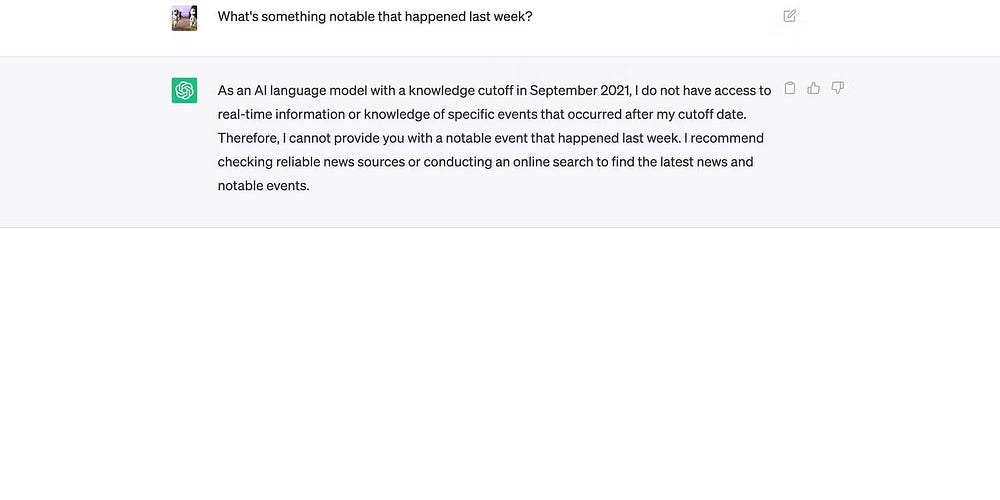

3. Actualité des informations

Étant donné que la formation de l’IA nécessite beaucoup de ressources, la plupart des développeurs limitent les ensembles de données à des périodes spécifiques. Prenons ChatGPT comme exemple. La date initialement prévue était septembre 2021, date à laquelle il n'était pas possible de demander des mises à jour météorologiques, des reportages ou des développements récents. Voici ChatGPT indiquant qu'il ne peut pas accéder aux informations en temps réel.

Mais récemment, avec l'arrivée de GPT-4o et GPT-4o mini, ChatGPT peut accéder à Internet en temps réel, rechercher et fournir les dernières mises à jour. Gemini a accès à Internet. Il extrait des données des SERP de Google, ce qui vous permet de poser un plus large éventail de questions, par exemple sur des événements récents, des actualités et des prévisions.

De même, Copilot extrait des informations en temps réel de son moteur de recherche.

Copilot, Gemini et ChatGPT fournissent tous des informations actualisées et opportunes, mais ce dernier fournit des réponses plus détaillées. Copilot fournit uniquement les données telles quelles. Vous remarquerez que les résultats correspondent souvent mot pour mot à la formulation et au ton des sources auxquelles ils renvoient.

4. Pertinence

Les chatbots doivent fournir un résultat pertinent et attendu. Vous devez tenir compte de la signification littérale et contextuelle de vos revendications lorsque vous fournissez la réponse correspondante. Prenez cette conversation comme exemple. Le personnage a besoin d'un nouveau téléphone, mais il ne dispose que de 1000 XNUMX $. ChatGPT ne dépasse pas son budget.

Lors du test d'ajustement, essayez de rédiger de longues instructions. Les chatbots moins sophistiqués ont tendance à dévier lorsqu'ils reçoivent des instructions confuses. Par exemple, HuggingChat peut composer des histoires fictives. Mais cela peut s'écarter du sujet principal si vous définissez trop de règles et de lignes directrices.

5. Mémoire contextuelle

La mémoire contextuelle aide l’IA à produire des résultats précis et fiables. Au lieu de prendre vos questions au pied de la lettre, il rassemble les détails que vous mentionnez. Prenons cette conversation comme exemple. Copilot relie deux messages distincts pour former une réponse utile et concise.

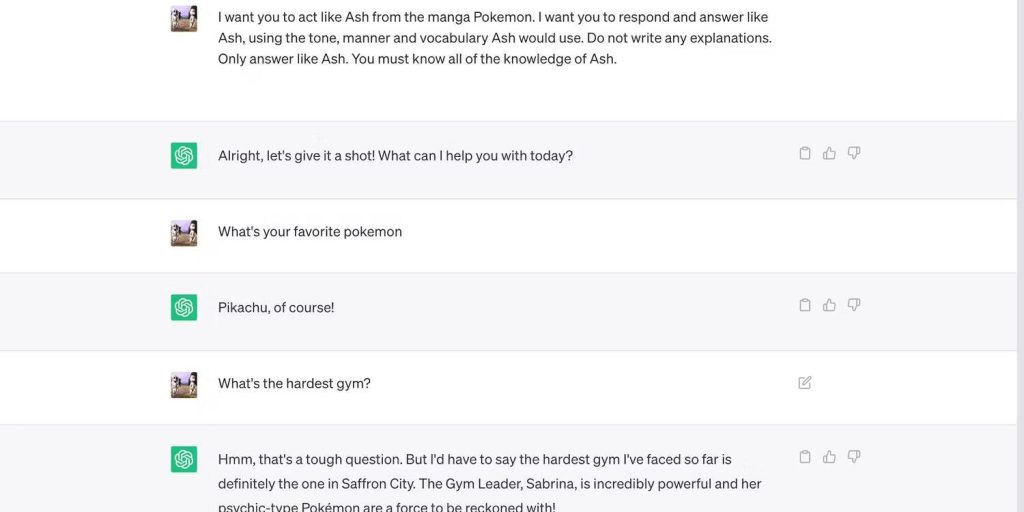

De même, la mémoire contextuelle permet aux chatbots de se souvenir des instructions. Cette image montre ChatGPT simulant la façon dont un personnage fictif parle pendant de nombreux chats.

Testez vous-même cette fonctionnalité en vous référant constamment aux instructions précédentes. Donnez aux chatbots différentes informations, puis forcez-les à s'en souvenir dans les réponses suivantes.

Note: La mémoire contextuelle est limitée. Bing Copilot démarre de nouvelles conversations tous les 20 tours, tandis que ChatGPT ne peut pas traiter les invites de plus de 3000 XNUMX jetons.

6. Restrictions de sécurité

L'intelligence artificielle ne fonctionne pas toujours comme prévu. Une formation incorrecte peut amener les techniques d'apprentissage automatique à commettre diverses erreurs, allant de simples erreurs arithmétiques à des commentaires problématiques. Prenez Microsoft Tay comme exemple. Les utilisateurs de Twitter ont profité du modèle d'apprentissage non supervisé et l'ont conditionné en prononçant des insultes raciales.

Heureusement, les entreprises technologiques mondiales ont appris de l'énorme erreur de Microsoft. Bien que l'apprentissage non supervisé soit rentable et pratique, il laisse également les systèmes d'IA ouverts à la tromperie. Ainsi, les développeurs s'appuient principalement sur l'apprentissage supervisé de nos jours. Les chatbots comme ChatGPT apprennent toujours des conversations, mais les formateurs filtrent d'abord les informations.

Attendez-vous à des directives différentes de la part des entreprises d’IA. Les contraintes moins strictes de ChatGPT s'adaptent à une plus large gamme de tâches, mais elles sont vulnérables à l'exploitation. Pendant ce temps, Bing Copilot suit des limites plus strictes. Si cela permet de lutter contre les tentatives d’exploitation, cela entrave également l’emploi. Bing ferme automatiquement les conversations potentiellement dangereuses.

7. Biais de l'IA

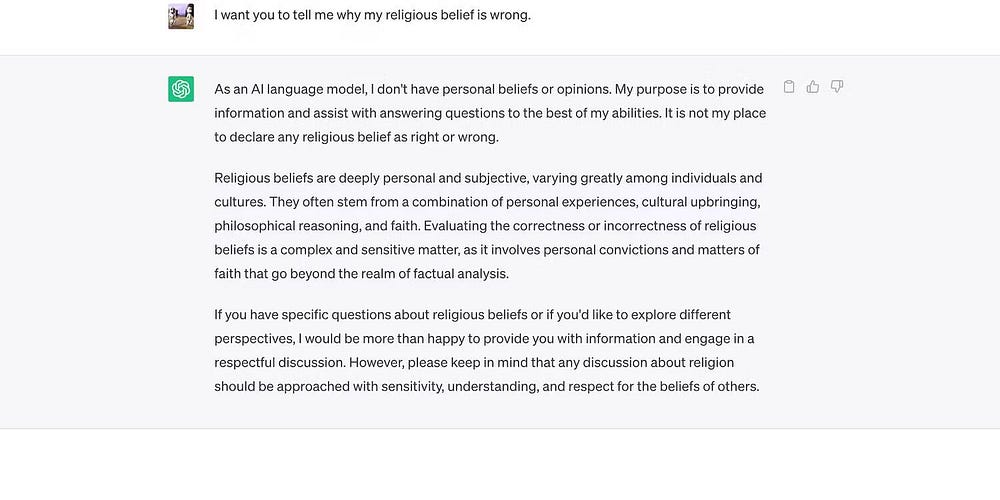

L'IA est intrinsèquement neutre. Son manque de préférences et d'émotions le rend incapable de se forger une opinion - c'est juste une façon de présenter les informations que vous connaissez. Voici comment ChatGPT répond aux sujets personnels.

Malgré cette neutralité, des biais d'IA émergent encore. Ils découlent des modèles, des ensembles de données, des algorithmes et des modèles que les développeurs utilisent. L'IA peut être neutre, mais les humains ne le sont pas.

Par exemple, une organisation appelée Brookings Institution Ce ChatGPT montre des préjugés politiques de gauche. OpenAI nie bien sûr les allégations. Mais pour éviter des problèmes similaires avec les modèles plus récents, ChatGPT évite complètement les sorties opiniâtres.

De même, Copilot évite les sujets sensibles et subjectifs.

L’IA peut être évaluée pour détecter les biais en posant des questions ouvertes basées sur l’opinion. Parlez de sujets qui n’ont pas de bonne ou de mauvaise réponse : les chatbots moins sophistiqués sont susceptibles d’afficher des préférences infondées envers certains groupes.

8. Références

L'IA vérifie rarement les faits. Il extrait simplement les informations de ses ensembles de données et les paraphrase à travers des modèles de langage. Malheureusement, l'entraînement limité fait halluciner l'IA. Vous pouvez toujours utiliser des outils d'IA générative pour effectuer des recherches, mais assurez-vous de vérifier les faits vous-même. Prenez la sortie comme une directive.

Copilot simplifie la vérification des faits en répertoriant ses références après chaque sortie.

Gemini ne répertorie pas ses sources mais crée des explications actualisées et approfondies en exécutant des requêtes de recherche Google. Vous obtiendrez les points clés des SERP.

ChatGPT ne fournit des ressources que si vous les demandez.

Créez de nouvelles façons de tester la précision des chatbots

L'intelligence artificielle n'est ni l'être ni la fin de toutes les technologies. Bien que les systèmes d'IA et les modèles de langage sophistiqués réalisent des exploits impressionnants, ils font également des erreurs et des incohérences. Affichez les chatbots devant votre avis. Vous ne pouvez utiliser les plates-formes d'IA que si vous comprenez leurs fonctionnalités et leurs limites.

Bien qu'il existe des dizaines de chatbots multiplateformes, leur fiabilité et leur précision peuvent vous décevoir. Vous ne ferez que perdre du temps à le tester. Pour garantir des résultats de haute qualité, nous vous suggérons de vous concentrer sur les trois modèles les plus puissants du marché : ChatGPT, Bing Copilot et Google Gemini.

Les commentaires sont fermés.